大模型的发展速度很快,对于需要学习部署使用大模型的人来说,显卡是一个必不可少的资源。使用公有云租用显卡对于初学者和技术验证来说成本很划算。DataLearnerAI在此推荐一个国内的合法的按分钟计费的4090显卡公有云服务提供商仙宫云,可以按分钟租用24GB显存的4090显卡公有云实例,非常具有吸引力~

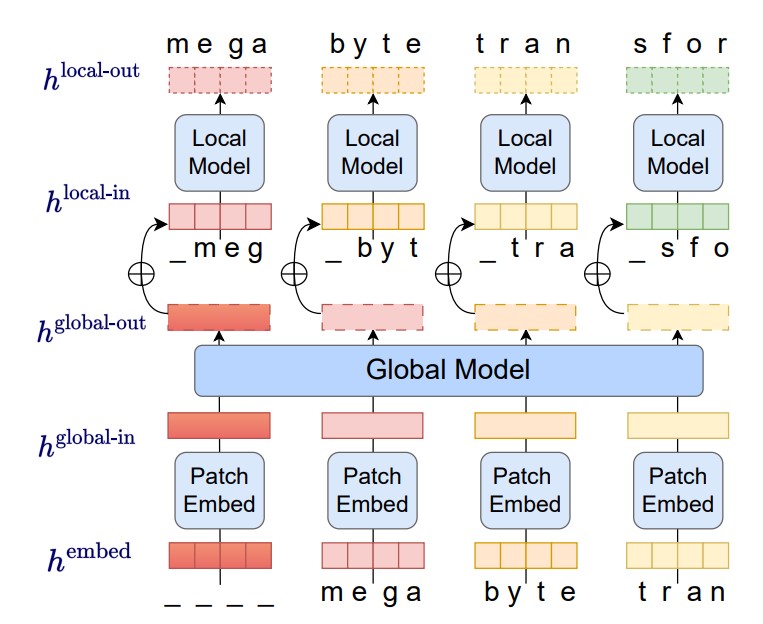

尽管OpenAI的ChatGPT很火爆,但是这类大语言模型有一个非常严重的问题就是对输入的内容长度有着很大的限制。例如,ChatGPT-3.5的输入限制是4096个tokens。MetaAI在前几天提交了一个论文,提出了MegaByte方法,几乎可以让模型接受任意长度的限制!

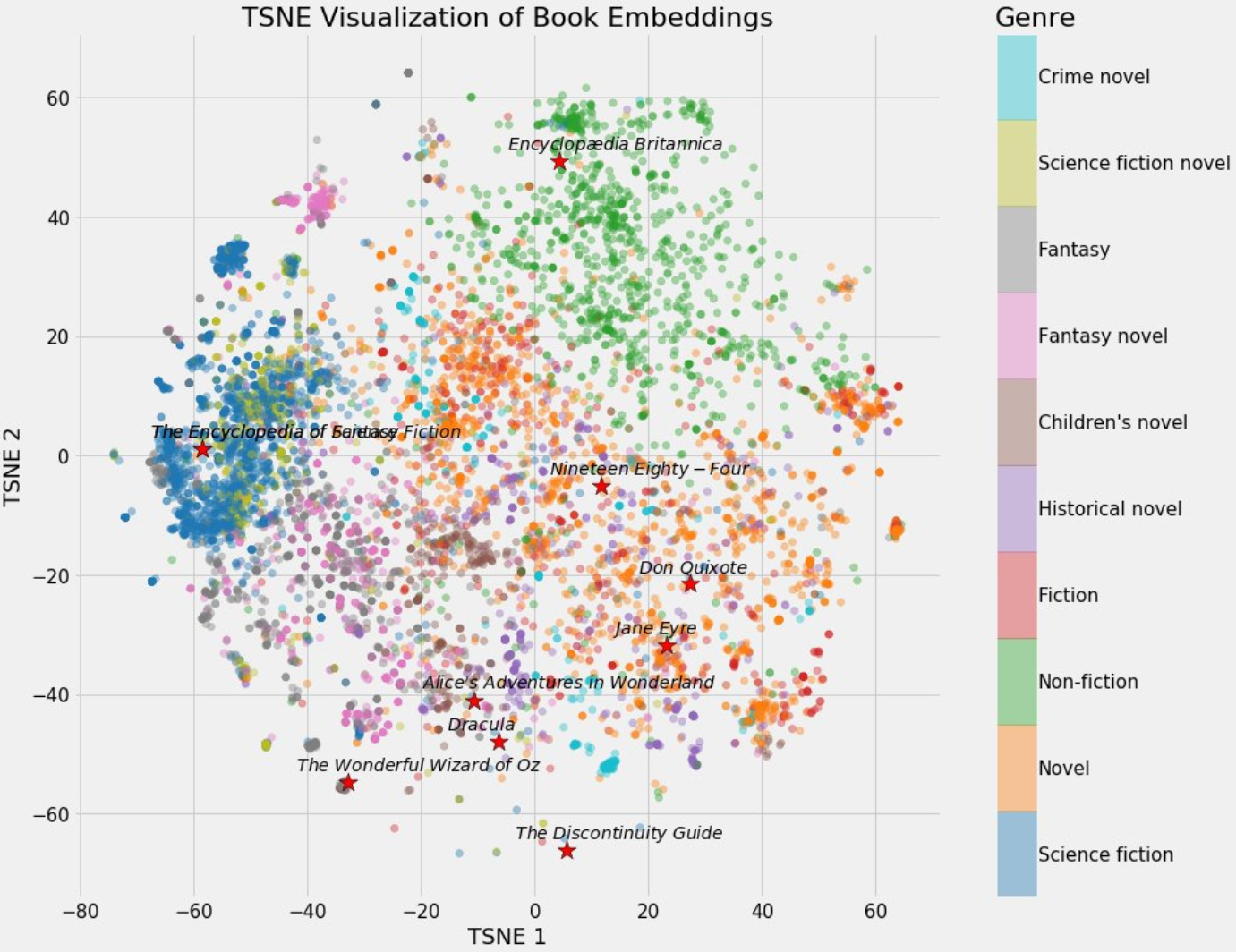

今天,推特上一位科技博主SullyOmarr分享了一个关于embedding的内容十分火爆。主要介绍为什么embedding对于在目前的AI大模型中很重要。这是一个十分不错的关于embedding知识的介绍。本文将根据SullyOmarr的内容也对embedding做一个简单的介绍,并解释为什么它在大语言模型中十分重要。

今日推荐

Transformer蓝图:Transformer 神经网络架构的综合指南——万字长文、20多个图片介绍大语言模型主流架构Transformer的发展历史、现状和未来结果

OpenAI发布最新最强大的AI对话系统——GPT3.5微调的产物ChatGPT

提炼BERT——将BERT转成小模型(Distilling BERT — How to achieve BERT performance using Logistic Regression)

LLaMA2 7B一样的性能但是由15倍的推理速度!Deci开源DeciLM-6B和DeciLM-6B-Instruct,发布一天上榜HuggingFace Trending

人工神经网络(Artificial Neural Network)算法简介

UWMadison前统计学教授详解大模型训练最重要的方法RLHF,RLHF原理、LLaMA2的RLHF详解以及RLHF替代方法