大模型的发展速度很快,对于需要学习部署使用大模型的人来说,显卡是一个必不可少的资源。使用公有云租用显卡对于初学者和技术验证来说成本很划算。DataLearnerAI在此推荐一个国内的合法的按分钟计费的4090显卡公有云服务提供商仙宫云,可以按分钟租用24GB显存的4090显卡公有云实例,非常具有吸引力~

今天The Information独家披露了一个令人兴奋的消息,那就是OpenAI正在开发一种Agent产品,可以通过控制用户的设备来帮助用户完成复杂的任务。

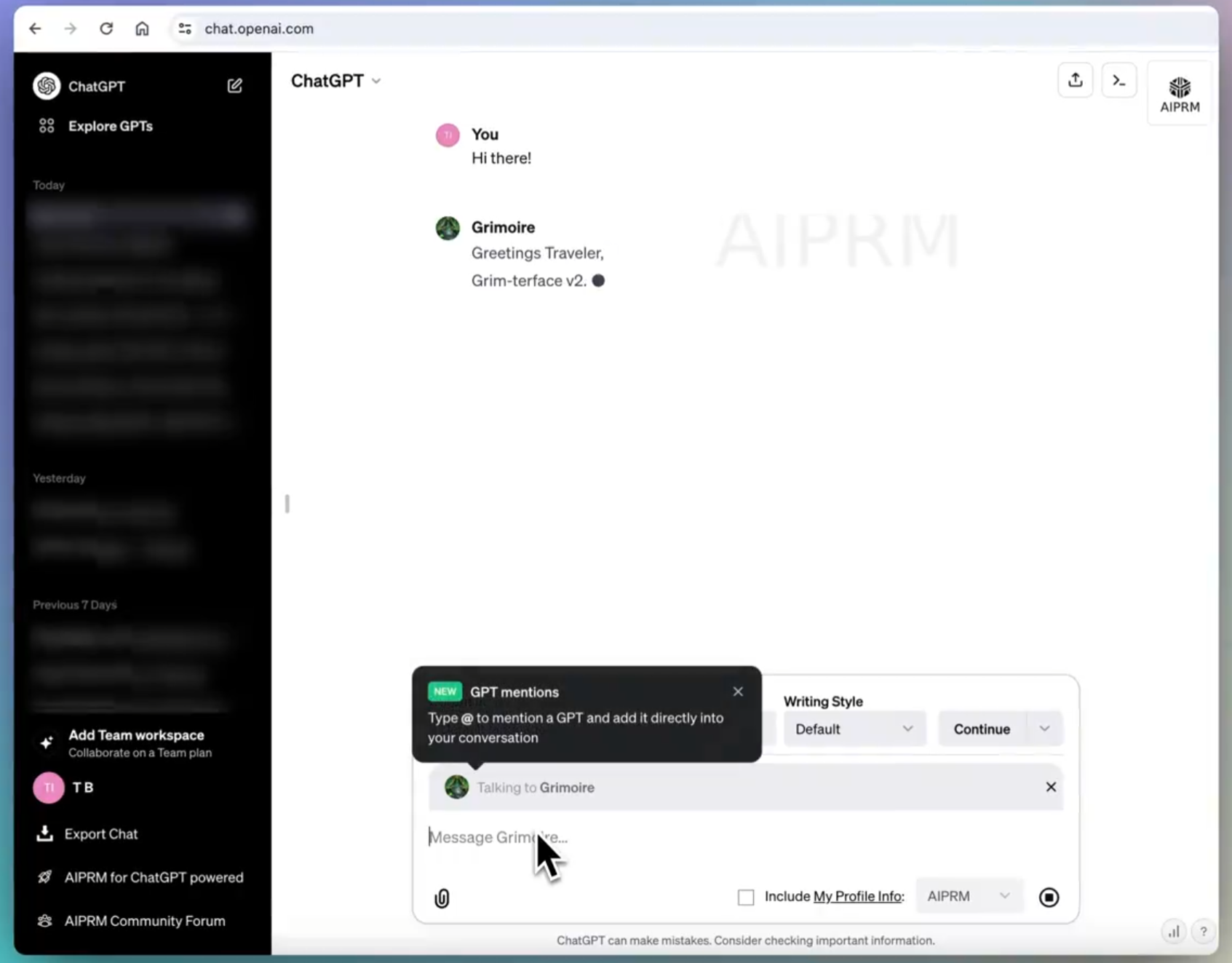

在最新的ChatGPT的前端代码中,有网友发现了一个OpenAI隐藏的或者正在测试的功能,即在ChatGPT的对话中可以@ 任意GPTs商店中公开的GPTs,然后由这个GPTs为用户当前的对话进行回复,这个功能不需要用户离开当前对话页面。这意味着在一次对话中,我们可以与几百万个不同的GPTs同时协作聊天,就像一个巨大的聊天群,里面有无数个各种各样的GPT一起为你解决问题。

今日推荐

tokens危机到来该怎么办?新加坡国立大学最新研究:为什么当前的大语言模型的训练都只有1次epoch?多次epochs的大模型训练是否有必要?

深度学习中为什么要使用Batch Normalization

康奈尔大学发布可以在一张消费级显卡上微调650亿参数规模大模型的框架:LLMTune

吴恩达AI系列短课再添精品课程:如何基于LangChain使用LLM构建私有数据的问答系统和聊天机器人

解决大语言模型的长输入限制:MetaAI发布MegaByte最高支持几百万上下文输入!

如何用7.7亿参数的蒸馏模型超过5400亿的大语言模型——Google提出新的模型蒸馏方法:逐步蒸馏(Distilling step-by-step)详解

Falcon-40B:截止目前最强大的开源大语言模型,超越MetaAI的LLaMA-65B的开源大语言模型