马斯克旗下xAI发布Grok-1.5,相比较开源的Grok-1,各项性能大幅提升,接近GPT-4!

Grok系列是马斯克旗下的人工智能企业xAI发布的大语言模型,在推特上给大家使用。第一个版本,Grok-1前端时间 开源,效果一般。就在刚才,xAI宣布他们开始内测Grok-1.5,即将全面商用!

Grok-1.5介绍

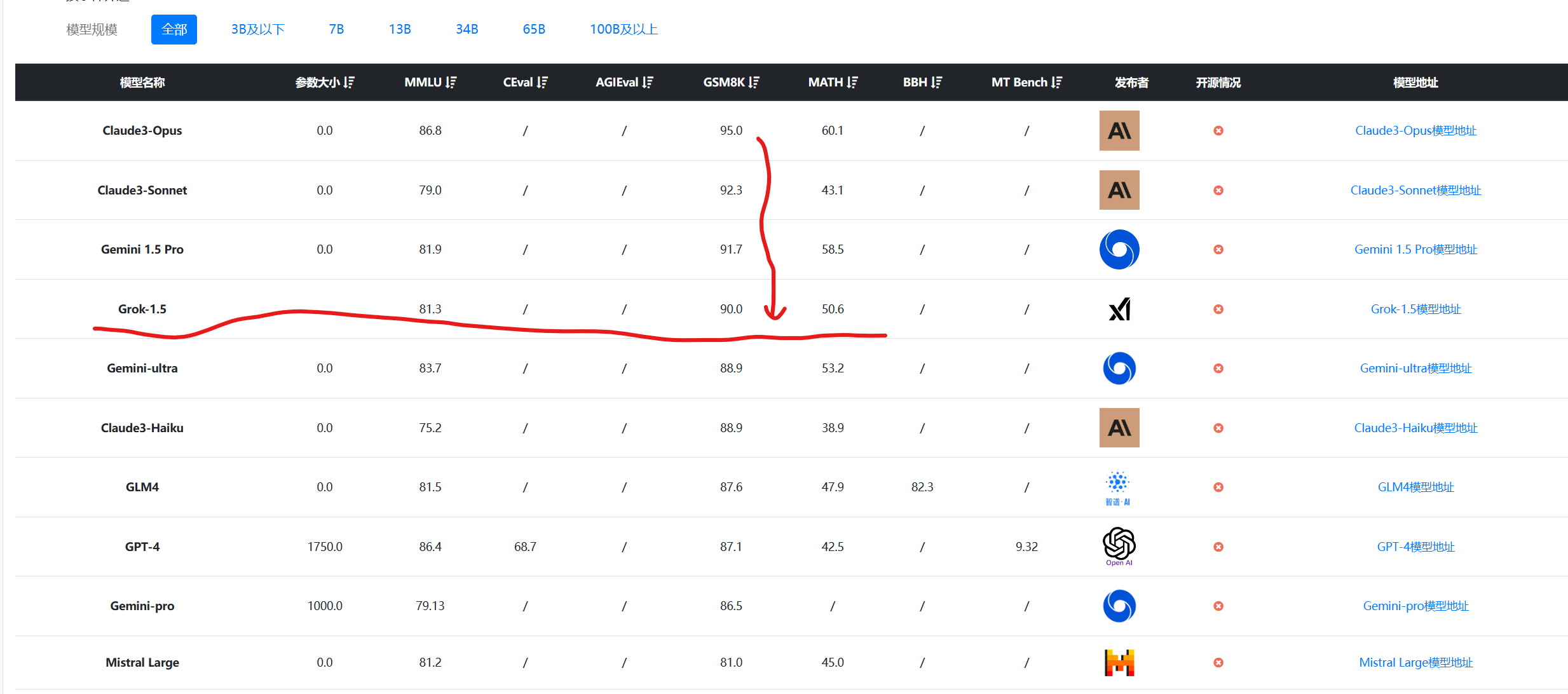

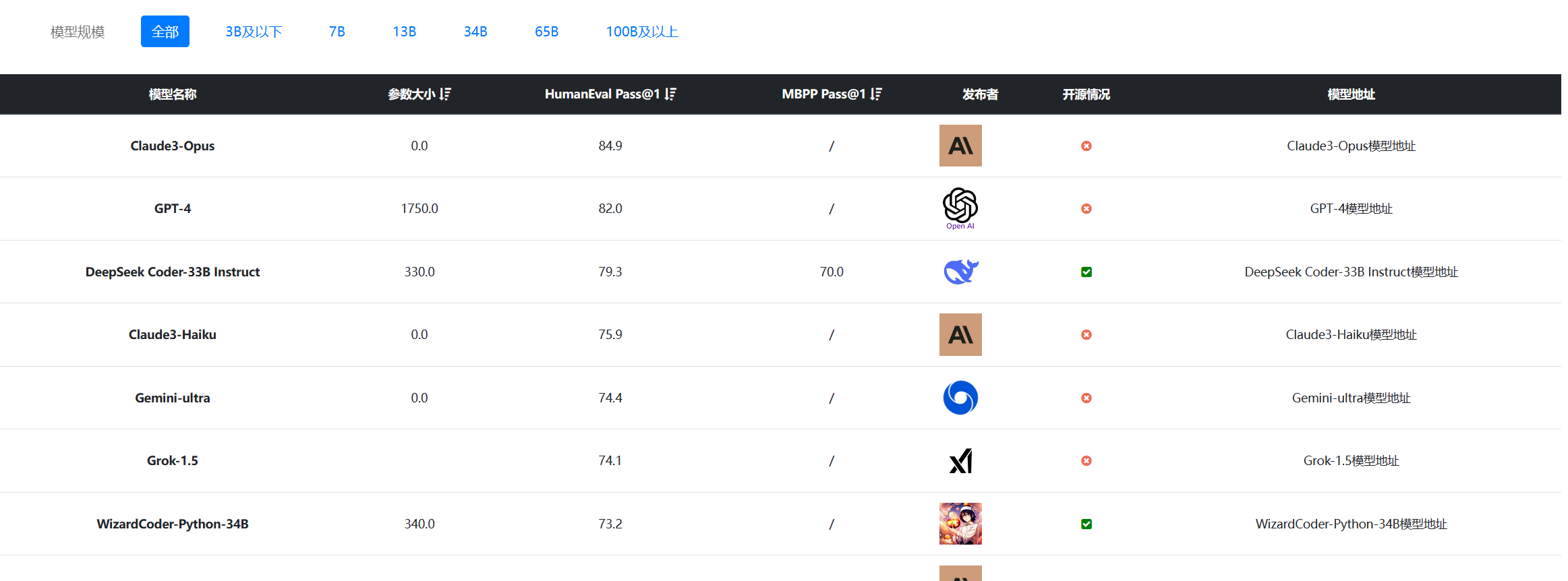

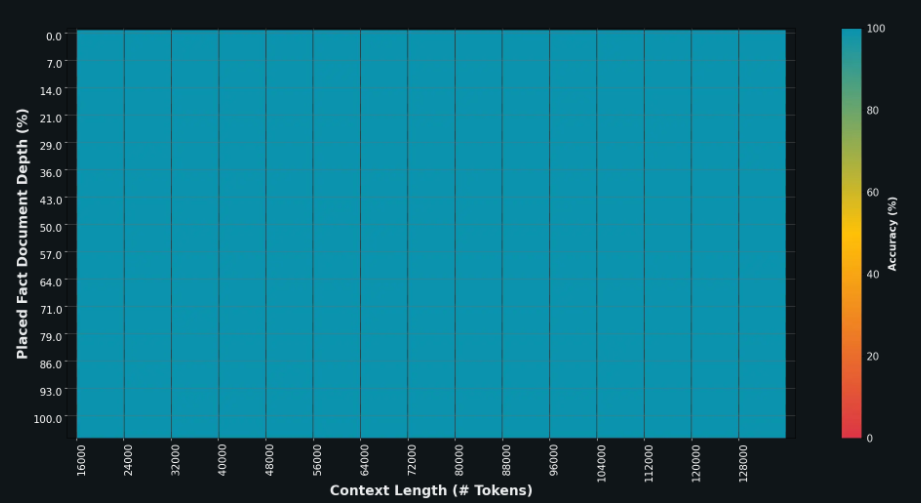

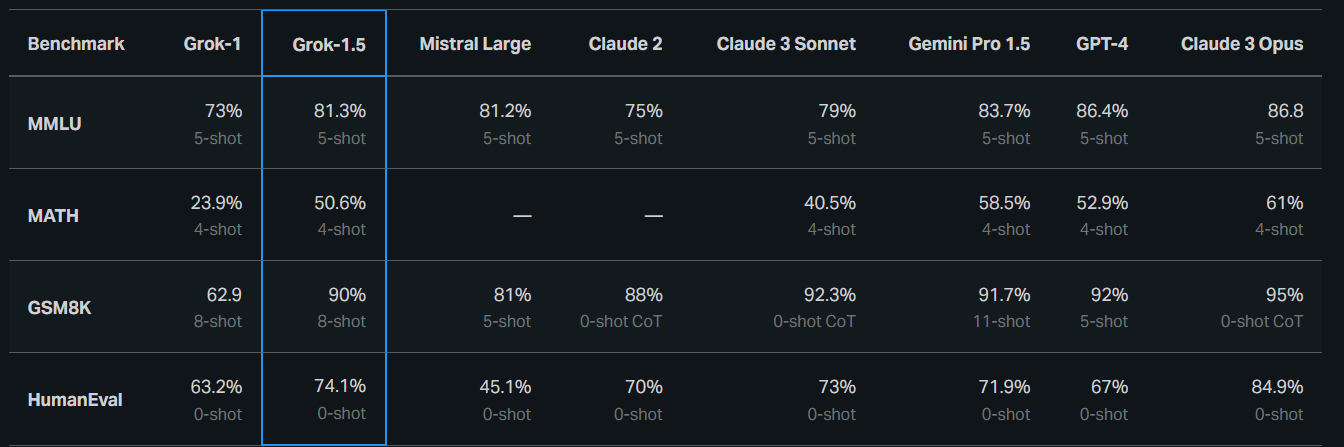

目前,官网没有公布Grok-1.5的任何技术细节,只说了这个版本的Grok-1.5在推理和其它任务解决的能力方面大幅提升。下图展示了Grok-1.5和其它模型的对比结果:

可以看到,在综合理解能力MMLU评测上,Grok-1.5达到了81.3分的成绩,超过了MistralAI当前最好的模型Mixtral Large,而数学推理能力GSM8K的成绩达到了90分!与GPT-4、Claude-3 Sonnet几乎差不多。