腾讯发布了一个全新的大模型Hunyuan Turbo S:号称评测效果超过GTP-4o和DeepSeek V3等模型,但没有开源或者放开使用

Hunyuan大模型是腾讯训练的大模型品牌名,2022年4月份,某中文语言理解能力排行榜第一名就出现了Hunyuan模型,在2022年11月,Hunyuan大模型就有了1万亿参数的规模,即HunYuan-NLP 1T大模型(比ChatGPT还早发布)。但是最近2年,这个系列的模型几乎没有出现在公众视野上。而昨天(2025年3月10日),Hunyuan官方在X平台上宣布了旗下最新的Hunyuan Turbo S大模型,称其在多个评测基准上超越了GPT-4o的表现。

一、Hunyuan Turbo S模型简介

Hunyuan Turbo S 的推出意在突破传统纯 Transformer 模型在长文本训练和推理时面临的瓶颈问题,如 O(N²) 的复杂度和 KV-Cache 限制。为此,模型采用了混合架构,将 Mamba 模型在长序列处理上的高效优势与 Transformer 在上下文理解方面的强大能力相结合。此外,该模型还在后训练阶段进行了多项增强:

- 慢思考集成:针对数学、编程和推理任务进行优化;

- 指令微调升级:提升模型对任务指令的对齐能力和代理执行效果;

- 英语训练优化:改善模型在通用场景下的表现。

腾讯方面表示,Hunyuan Turbo S 在数学、逻辑推理及对齐等任务上超越了 GPT-4o-0806、DeepSeek-V3 以及部分开源模型,同时在知识类评测(包括 MMLU-Pro)上也具备较强竞争力,并实现了比上一代 Turbo 模型低 1/7 的推理成本。

二、Hunyuan Turbo S模型技术架构特点

Hunyuan Turbo S 的一大亮点在于其混合架构创新,主要体现在以下两个方面:

Fast Thinking 与 Slow Thinking 的结合

- Fast Thinking(快思考):类似人类直觉,能够针对简单或常见问题给出即时响应。该机制通过将单词生成速度翻倍和减少首词延迟 44% 来实现高效对话和快速交互。

- Slow Thinking(慢思考):灵感来源于人类的深度分析思维,专门用于处理数学、逻辑推理以及科学相关的复杂问题。Turbo S 借鉴了腾讯早前的 Hunyuan T1 模型中通过长思考链合成技术训练出的慢思考能力,从而使其在多步推理问题上表现出色。

Hybrid-Mamba-Transformer 融合架构

- Mamba 模型:作为一种状态空间模型(SSM),Mamba 在处理长文本序列时内存占用更低、效率更高。其设计有效规避了 Transformer 在 KV-Cache 计算中遇到的二次方复杂度问题,非常适合处理法律文书、研究论文等长文本任务。

- Transformer 模型:在捕捉复杂上下文关系上具有明显优势,擅长多步推理、代码生成和深层次语义理解。

- MoE(专家混合)机制:Hunyuan Turbo S 是首个将 Mamba 成功整合进超大规模 MoE 模型的案例。MoE 模型仅激活部分参数进行计算,这大幅降低了计算资源需求,同时保持了模型在推理和推理深度方面的优越表现。

这种架构创新不仅实现了训练与推理成本的显著降低,还在速度与智能水平上达到了平衡,为未来基于长文本、推理和代码等任务的衍生模型奠定了基础。

三、Hunyuan Turbo S模型评测结果

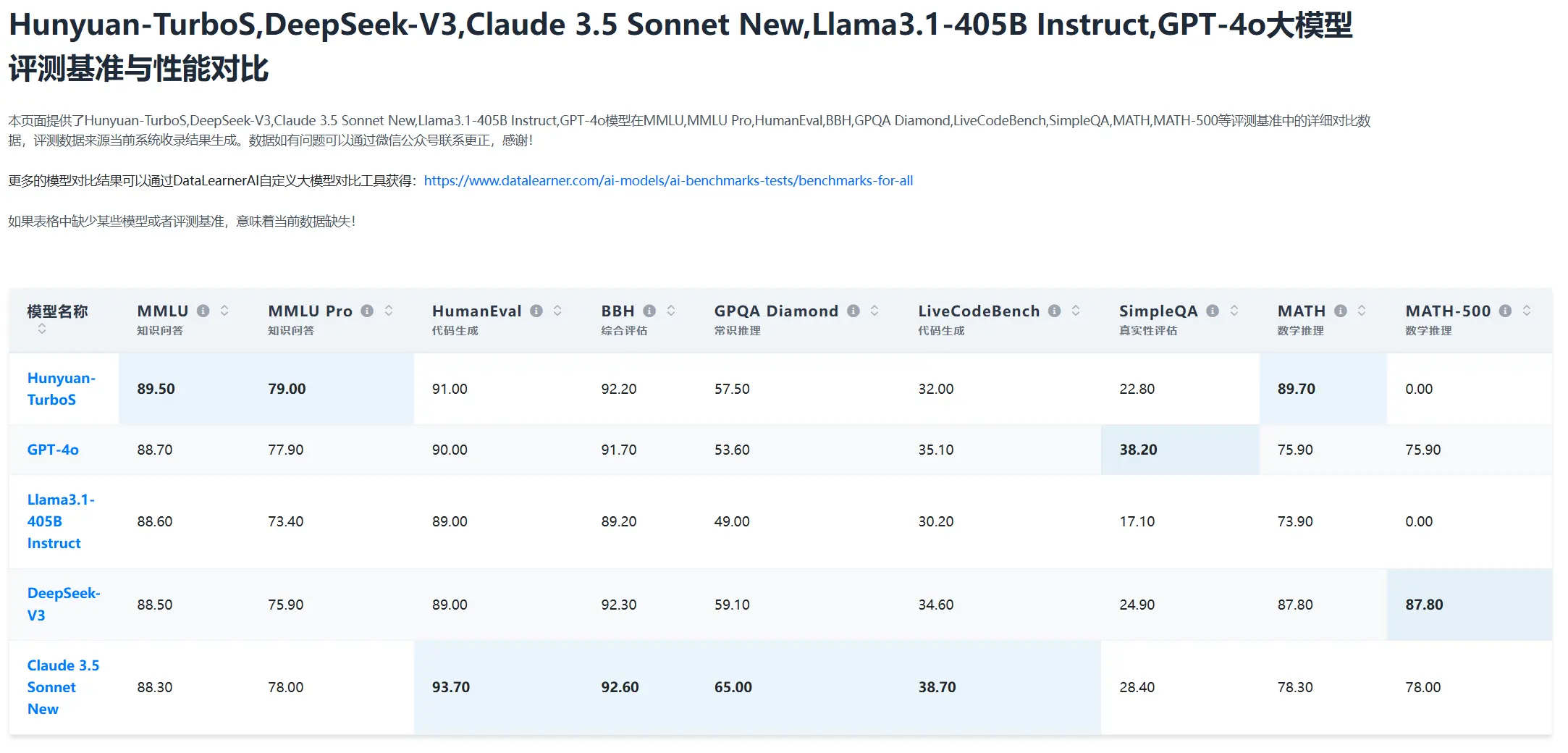

根据公开基准评测数据,Hunyuan Turbo S 在多个任务上展现了优异的性能,下图是DataLearnerAI大模型排行榜上Hunyuan Turbo S与其它模型对比:

从上图我们可以看到: Hunyuan Turbo S在MMLU、MMLU Pro等通用知识能力上的评测超过了当前主流的最强模型,分数分别是89.5分和79分,超过了GPT-4o、DeepSeek V3等。在编程方面也是非常强,除了逆天的Claude Sonnet 3.5 New以外,各方面得分都很高。

此外,该模型在指令调优和奖励系统上也做出了优化:结合基于规则的评分、代码沙箱反馈以及生成式奖励机制,进一步提升了 STEM 任务的准确性和问答创意,减少了奖励系统被攻击的风险。

不过,在简单问答(SimpleQA)和 LiveCodeBench 任务中,GPT-4o 和 Claude 3.5 仍略占优势。

四、Hunyuan Turbo S模型目前似乎不开放使用

尽管官方宣称Hunyuan Turbo S的各个能力都非常强,但是遗憾的是目前并没有开源或者提供大家使用。所以我们也只能从公布的一些信息中去推测和洞察这个模型。

关于Hunyuan Turbo S的其他信息以及后续的更新参考DataLearnerAI大模型信息卡:https://www.datalearner.com/ai-models/pretrained-models/Hunyuan-TurboS