MPT-7B-StoryWriter-65k+ - MosaicML Pretrained Transformer - 7B StoryWriter 65k+

模型详细情况和参数

MPT-7B-StoryWriter-65k+

- 模型全称

- MosaicML Pretrained Transformer - 7B StoryWriter 65k+

- 模型简称

- MPT-7B-StoryWriter-65k+

- 模型类型

- 基础大模型

- 发布日期

- 2023-05-05

- 预训练文件大小

- 13.3GB

- 是否支持中文(中文优化)

- 否

- 最高支持的上下文长度

- 65K

- 模型参数数量(亿)

- 67.0

- 模型代码开源协议

- Apache 2.0

- 预训练结果开源商用情况

- Apache 2.0 - 免费商用授权

- 模型GitHub链接

- https://github.com/mosaicml/llm-foundry

- 模型HuggingFace链接

- https://huggingface.co/mosaicml/mpt-7b-storywriter

- 在线演示地址

- 暂无

- 基础模型

-

MPT

查看详情 - 发布机构

MosaicML Pretrained Transformer - 7B StoryWriter 65k+ 简介

MPT-7B-StoryWriter-65k+是MPT-7B系列模型中针对超长上下文输入进行优化的模型。

MPT是由MosaicML推出的transformer系列大模型,其中7B是指67亿参数规模,MPT全称MosaicML Pretrained Transformer,关于MPT系列模型请参考: https://www.datalearner.com/ai-models/foundation-models/MPT

MPT-7B-StoryWriter-65k+是一个旨在读取和写入具有超长上下文长度的故事的模型。它是通过对MPT-7B进行微调而建立的,其上下文长度为65k tokens,在Books3数据集的一个过滤小说子集上进行微调。由于使用了ALiBi技术,MPT-7B-StoryWriter-65k+甚至可以推断出超过65k tokens的内容,官方宣称已经在A100-80GB GPU的单节点上演示了长达84k tokens的输出。

欢迎大家关注DataLearner官方微信,接受最新的AI模型和技术推送

MPT-7B-StoryWriter-65k+所属的领域

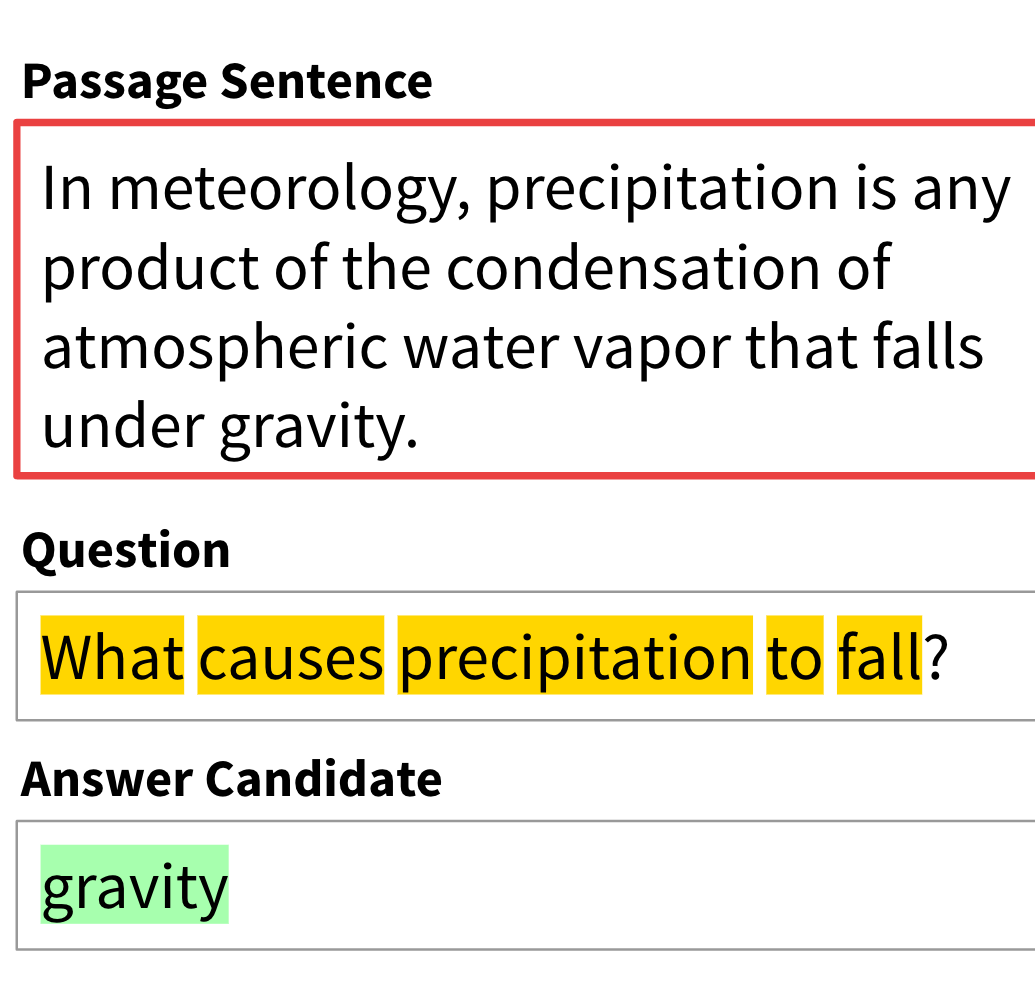

MPT-7B-StoryWriter-65k+相关的任务