Qwen1.5-MoE-A2.7B - Qwen1.5-MoE-A2.7B

模型详细情况和参数

Qwen1.5-MoE-A2.7B

- 模型全称

- Qwen1.5-MoE-A2.7B

- 模型简称

- Qwen1.5-MoE-A2.7B

- 模型类型

- 基础大模型

- 发布日期

- 2024-03-28

- 预训练文件大小

- 3.46GB

- 是否支持中文(中文优化)

- 是

- 最高支持的上下文长度

- 1K

- 模型参数数量(亿)

- 143.0

- 预训练结果开源商用情况

- Tongyi Qianwen RESEARCH LICENSE AGREEMENT - 免费商用授权

- 模型GitHub链接

- https://github.com/QwenLM/Qwen1.5

- 模型HuggingFace链接

- https://huggingface.co/Qwen

- 在线演示地址

- 暂无

- DataLearnerAI的模型介绍

- 重磅!阿里巴巴开源自家首个MoE技术大模型:Qwen1.5-MoE-A2.7B,性能约等于70亿参数规模的大模型Mistral-7B

- 基础模型

- 无基础模型

- 发布机构

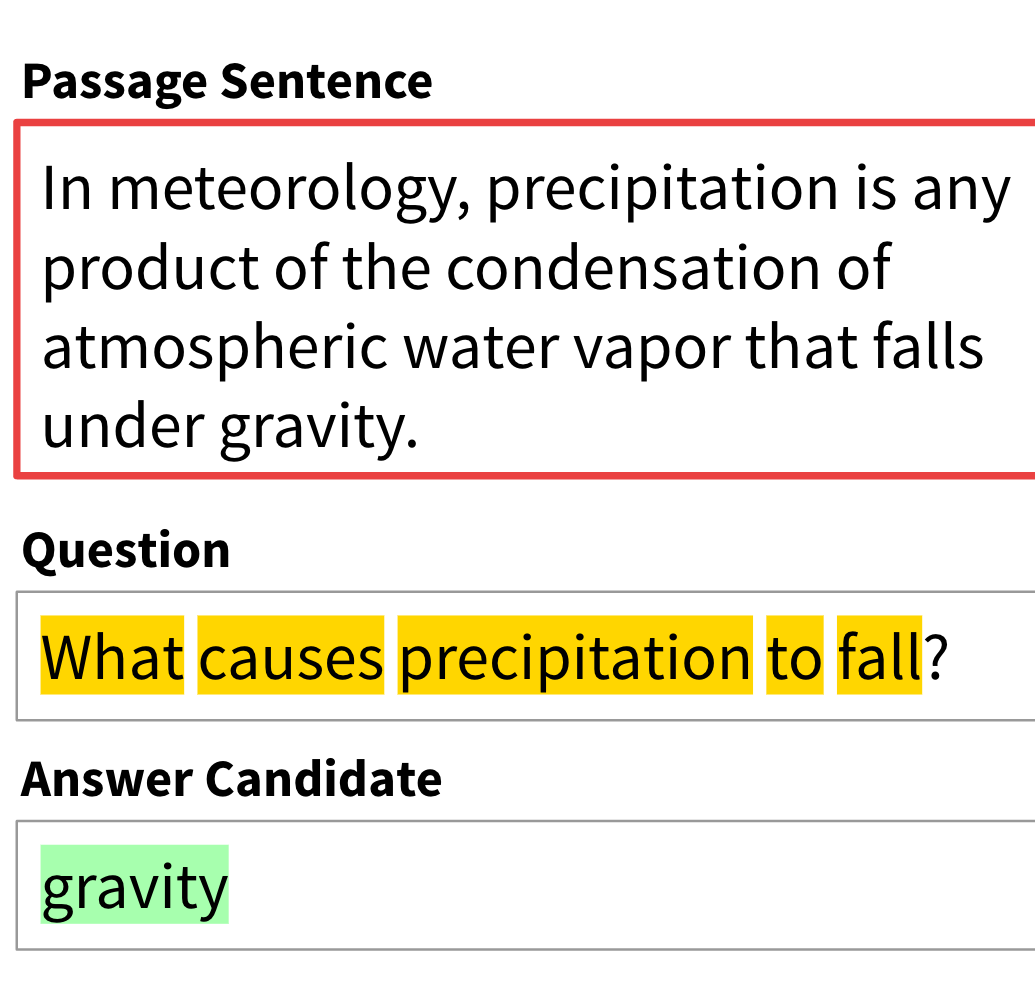

Qwen1.5-MoE-A2.7B 简介

阿里巴巴开源的阿里系首个MoE大语言模型,143亿参数模型效果与70亿差不多,但是每次推理只激活27亿参数,可以在手机端运行。

欢迎大家关注DataLearner官方微信,接受最新的AI模型和技术推送

Qwen1.5-MoE-A2.7B所属的领域

Qwen1.5-MoE-A2.7B相关的任务