Ziya-LLaMA-13B-Pretrain-v1 - Ziya-LLaMA-13B-Pretrain-v1

模型详细情况和参数

Ziya-LLaMA-13B-Pretrain-v1

- 模型全称

- Ziya-LLaMA-13B-Pretrain-v1

- 模型简称

- Ziya-LLaMA-13B-Pretrain-v1

- 模型类型

- 基础大模型

- 发布日期

- 2023-06-01

- 预训练文件大小

- 26

- 是否支持中文(中文优化)

- 是

- 最高支持的上下文长度

- 4K

- 模型参数数量(亿)

- 130.0

- 模型代码开源协议

- Apache 2.0

- 预训练结果开源商用情况

- 开源不可商用 - 不可以商用

- 模型GitHub链接

- https://github.com/IDEA-CCNL/Fengshenbang-LM

- 模型HuggingFace链接

- https://huggingface.co/IDEA-CCNL/Ziya-LLaMA-13B-Pretrain-v1

- 在线演示地址

- 暂无

- 官方博客论文

- 暂无

- 基础模型

-

LLaMA

查看详情 - 发布机构

Ziya-LLaMA-13B-Pretrain-v1 简介

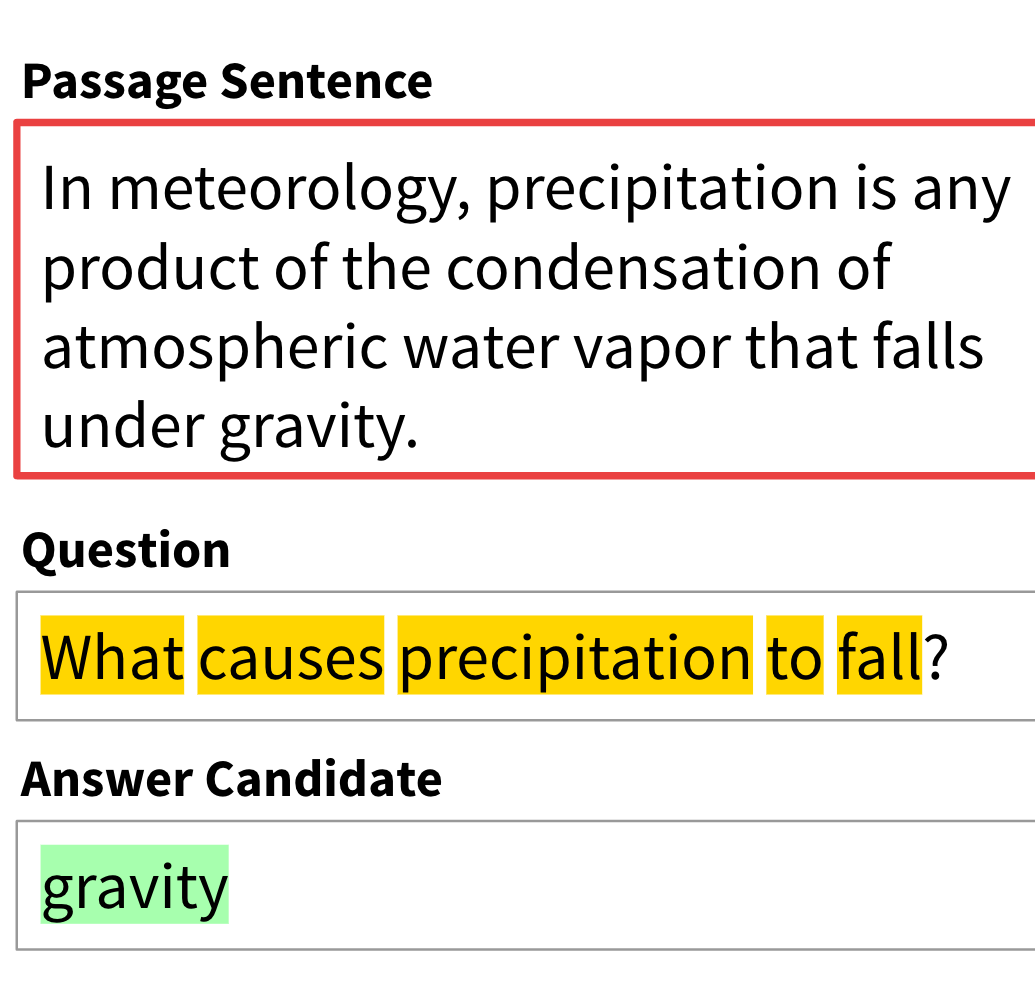

Ziya-LLaMA-13B-Pretrain-v1 是基于LLaMa的130亿参数大规模预训练模型,针对中文分词优化,并完成了中英文 110B tokens 的增量预训练,进一步提升了中文生成和理解能力。目前姜子牙通用大模型 Ziya-LLaMA-13B-v1 在本模型上,进一步完成了多任务有监督微调和人类反馈学习阶段的训练过程,具备翻译,编程,文本分类,信息抽取,摘要,文案生成,常识问答和数学计算等能力。

欢迎大家关注DataLearner官方微信,接受最新的AI模型和技术推送

Ziya-LLaMA-13B-Pretrain-v1所属的领域

Ziya-LLaMA-13B-Pretrain-v1相关的任务