集成学习(Ensemble Learning)简介及总结

一、基本思想

**集成学习(Ensemble Learning)**是解决有监督机器学习任务的一类方法,它的思路是基于多个学习算法的集成来提升预测结果。

通常情况下,有监督的学习方法都是针对一个问题从一个有限的假设空间中搜索最适合结果。这里就包含了两个问题,一个是假设空间中是否包含了合适的方案,另一个是假设这个方案存在,模型是否可以搜寻到。而集成学习就是将多个假设空间放到一起来形成一个更好的方案。

集成学习的结果是一个单一的假设空间,不一定是在原始分类器的假设空间中,因此具有更高的灵活性。理论上说,集成学习可以在训练集上比单一的模型有更好的拟合能力,而某些集成学习方法(如bagging)在实际中也能更好地降低过拟合的问题。集成学习也会给予分类性能好的分类器更高的权重。

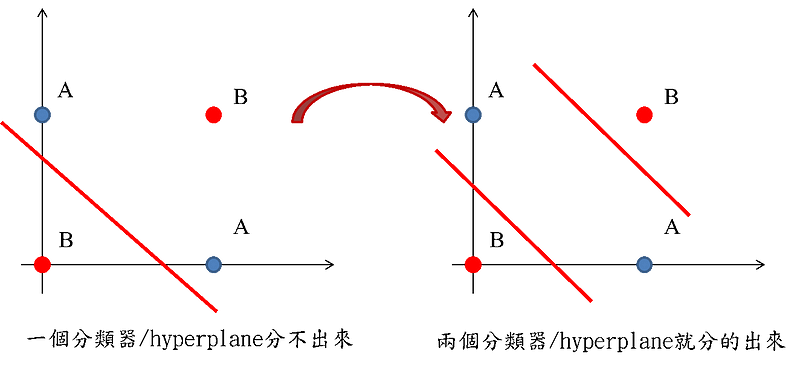

如上图所示,单个线性分类器可能无法分割上述数据,但是两个线性分类器就可以了。这是集成学习一个简单的举例。