如何训练一个大语言模型?当前基于transformer架构的大语言模型的通用训练流程介绍

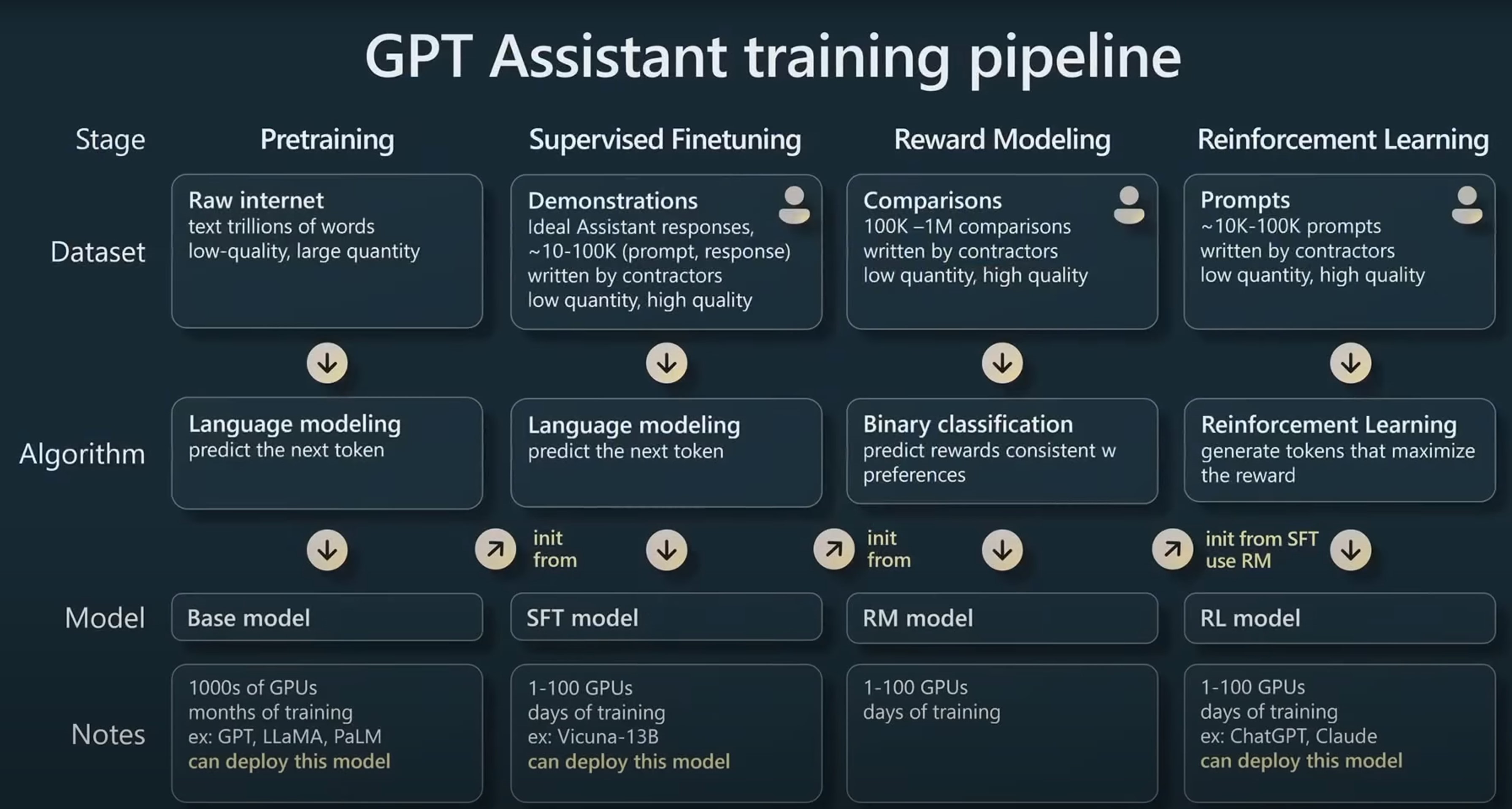

在当今的人工智能领域,大型语言模型(LLM)已成为备受瞩目的研究方向之一。它们能够理解和生成人类语言,为各种自然语言处理任务提供强大的能力。然而,这些模型的训练不仅仅是将数据输入神经网络,还包括一个复杂的管线,其中包括预训练、监督微调和对齐三个关键步骤。本文将详细介绍这三个步骤,特别关注强化学习与人类反馈(RLHF)的作用和重要性。

规范的LLM训练管线

现代基于变换器的LLM,如ChatGPT和Llama 2,通常经历以下三个关键步骤的训练过程:

1. 预训练(Pretraining)

预训练是LLM训练的第一阶段,它在大规模未标记的文本数据集上进行。这个阶段的主要目标是使模型吸收大量的知识和语言结构。预训练阶段采用了自监督学习方法,其中模型预测给定上下文下一个词或令牌是什么。