OpenAI隐藏的一个ChatGPT新功能:在对话框中@任意GPTs,获得回答!一个巨大的由各种GPT组成的聊天世界即将到来

1,124 阅读

在最新的ChatGPT的前端代码中,有网友发现了一个OpenAI隐藏的或者正在测试的功能,即在ChatGPT的对话中可以@ 任意GPTs商店中公开的GPTs,然后由这个GPTs为用户当前的对话进行回复,这个功能不需要用户离开当前对话页面。这意味着在一次对话中,我们可以与几百万个不同的GPTs同时协作聊天,就像一个巨大的聊天群,里面有无数个各种各样的GPT一起为你解决问题。

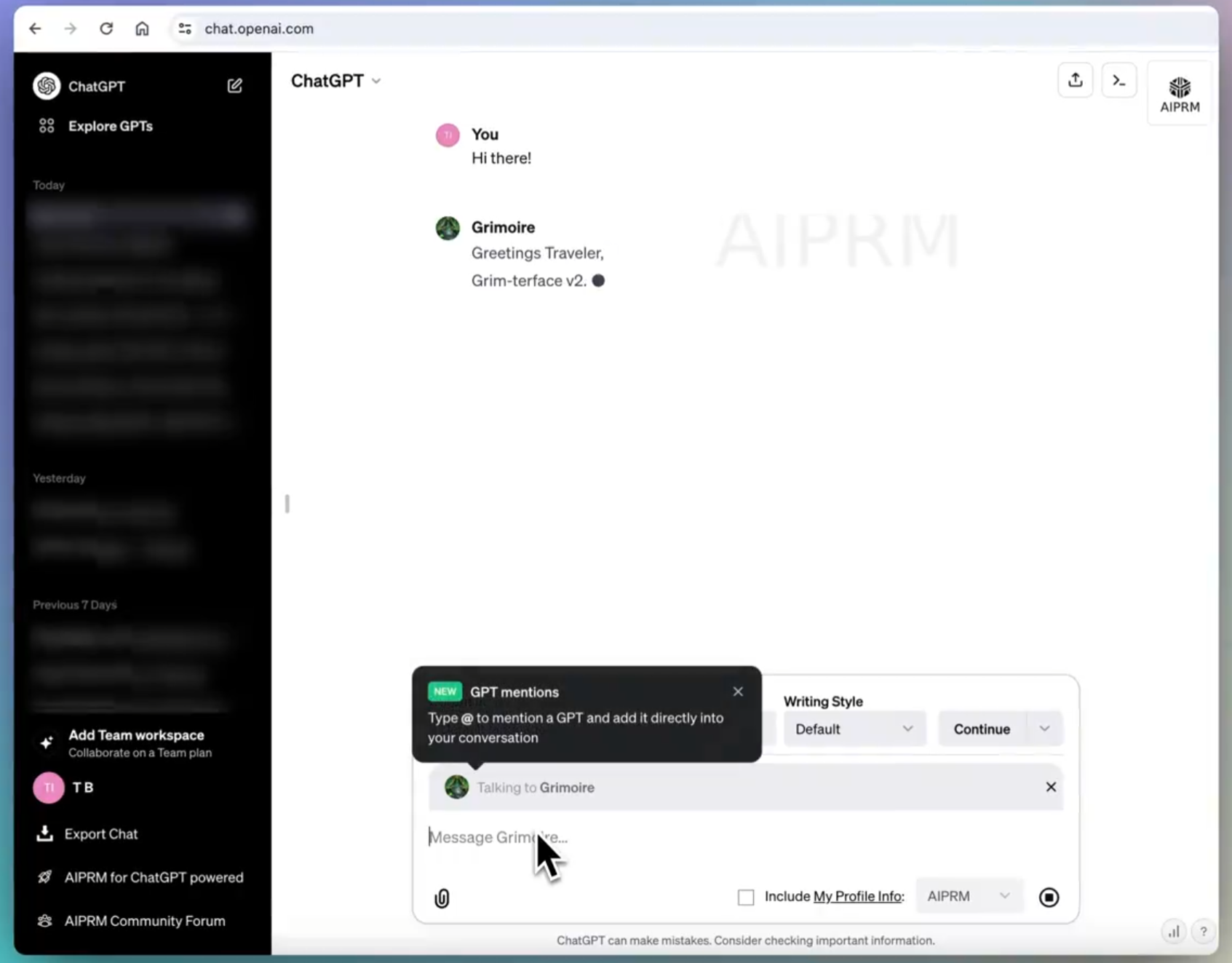

下图是网友通过源代码还原的一个@ GPTs的效果。在对话框中你只要@ 即可出现GPTs候选框,如下图所示:

使用鼠标点击具体的某个GPTs,就会出现与XX GPTs对话的聊天提示:

这时候你输入的任何内容都会被发送到这个GPTs,之后聊天框回答就是由该GPTs产生。当然,在下次对话的时候你依然可以换一个GPTs来@,这样可以一次对话中与N个不同的GPTs对话了。