如何训练一个大语言模型?当前基于transformer架构的大语言模型的通用训练流程介绍

在当今的人工智能领域,大型语言模型(LLM)已成为备受瞩目的研究方向之一。它们能够理解和生成人类语言,为各种自然语言处理任务提供强大的能力。然而,这些模型的训练不仅仅是将数据输入神经网络,还包括一个复杂的管线,其中包括预训练、监督微调和对齐三个关键步骤。本文将详细介绍这三个步骤,特别关注强化学习与人类反馈(RLHF)的作用和重要性。

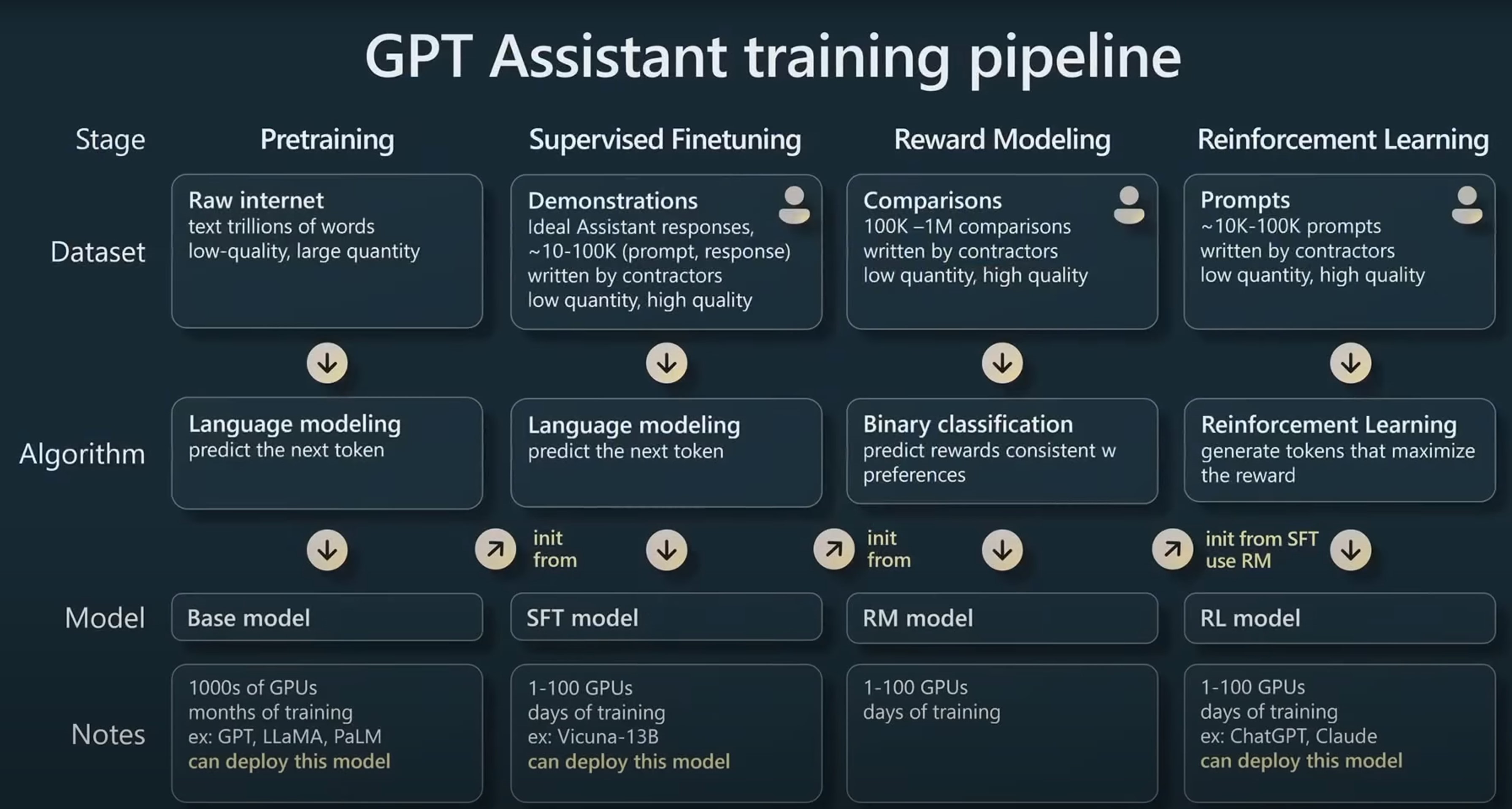

规范的LLM训练管线

现代基于变换器的LLM,如ChatGPT和Llama 2,通常经历以下三个关键步骤的训练过程:

1. 预训练(Pretraining)

预训练是LLM训练的第一阶段,它在大规模未标记的文本数据集上进行。这个阶段的主要目标是使模型吸收大量的知识和语言结构。预训练阶段采用了自监督学习方法,其中模型预测给定上下文下一个词或令牌是什么。

-

数据集选择:通常使用包含数十亿到数万亿令牌的庞大文本语料库,如互联网文本。

-

自监督学习:模型根据文本数据的上下文预测下一个词,这种任务称为下一个词预测。通过这个任务,模型学习了语法、语义和常识知识。

2. 监督微调(Supervised Fine-Tuning)

监督微调是LLM训练的第二阶段,其目的是根据特定任务或指令微调模型,使其更适合执行具体的自然语言处理任务。与预训练不同,监督微调需要特定的标记数据集,其中包含了指令和相应的期望输出。

-

数据集准备:人类编写指令-输出对,指令是模型的输入,期望输出是我们期望模型生成的内容。这通常需要耗费大量人力和时间。

-

任务多样性:监督微调可以应用于各种任务,如翻译、问题回答、摘要生成等。

-

微调策略:模型参数根据监督数据的误差进行微调,以提高在指定任务上的性能。

3. 对齐(Alignment)与RLHF

对齐阶段是LLM训练的第三阶段,也是本文的重点。它的目标是将LLM的输出与人类偏好对齐,以进一步提高模型的性能、帮助性和安全性。这一阶段常常涉及强化学习与人类反馈(RLHF)的应用。

强化学习与人类反馈(RLHF)

RLHF是对齐阶段的核心。它为模型提供了一个持续学习和改进的机制。在RLHF中,模型生成文本,并接收人类提供的反馈信息。

-

反馈回路:RLHF创建了一个循环,模型生成文本,然后根据人类反馈进行调整。反馈可以是积极的,表示模型生成的文本是合适的,也可以是消极的,表示需要改进。

-

渐进改进:通过多次迭代,模型逐渐提高其生成文本的质量,以更好地满足用户的需求。这种渐进改进有助于模型更好地理解人类的期望和意图。

-

安全性提升:RLHF还可以用于提高模型的安全性,减少不当内容的生成。模型可以通过学习避免不恰当的回应来提高安全性。

结论

规范的大语言模型训练管线包括预训练、监督微调和对齐这三个关键步骤。强化学习与人类反馈(RLHF)在对齐阶段扮演着重要角色,通过不断的学习和调整,模型能够逐渐提高其生成文本的质量,以更好地满足用户的需求。随着LLM领域的不断发展,我们可以期待更多创新的方法和技术,以进一步提升这些语言模型的能力和可用性。如果您对RLHF或LLM训练管线的任何方面有疑问,欢迎随时提出,我们将不断更新并分享最新的研究成果。