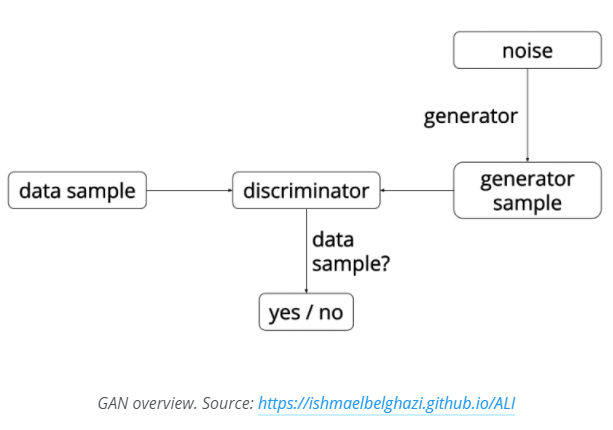

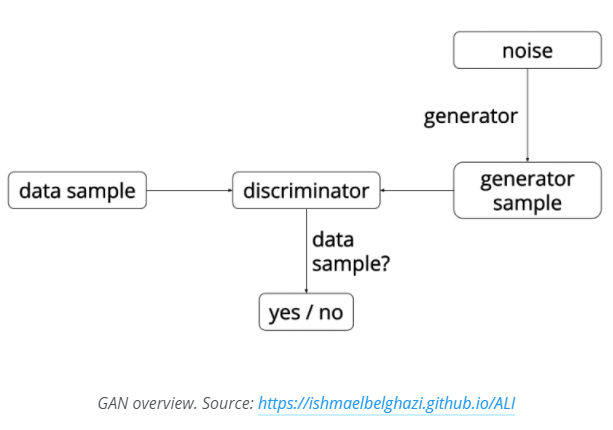

生成对抗网络简介(包含TensorFlow代码示例)【翻译】

这篇博客是AYLIEN上的一篇关于生成对抗网络的简单介绍,包含非常简洁的代码示例。是入门非常好的材料。

聚焦人工智能、大模型与深度学习的精选内容,涵盖技术解析、行业洞察和实践经验,帮助你快速掌握值得关注的AI资讯。

这篇博客是AYLIEN上的一篇关于生成对抗网络的简单介绍,包含非常简洁的代码示例。是入门非常好的材料。

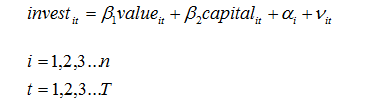

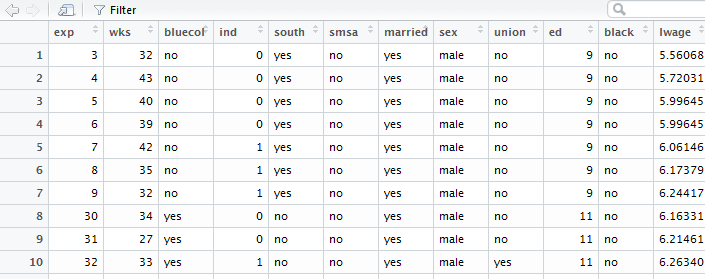

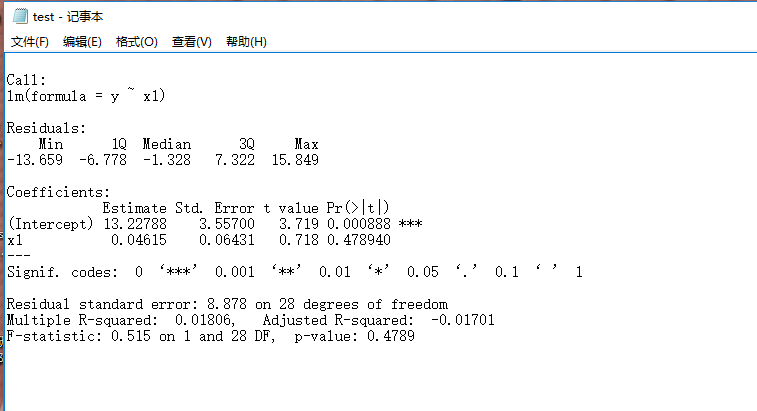

R语言,面板数据,动态回归

word2vec的各种程序运行方法

面板数据,即Panel Data,也叫“平行数据”,是指在时间序列上取多个截面,本文介绍了一个R语言处理面板数据的案例

受限玻尔兹曼机(Restricted Boltzmann Machine,RBM)是G.Hinton教授的一宝。Hinton教授是深度学习的开山鼻祖,也正是他在2006年的关于深度信念网络DBN的工作,以及逐层预训练的训练方法,开启了深度学习的序章。其中,DBN中在层间的预训练就采用了RBM算法模型。RBM是一种无向图模型,也是一种神经网络模型。

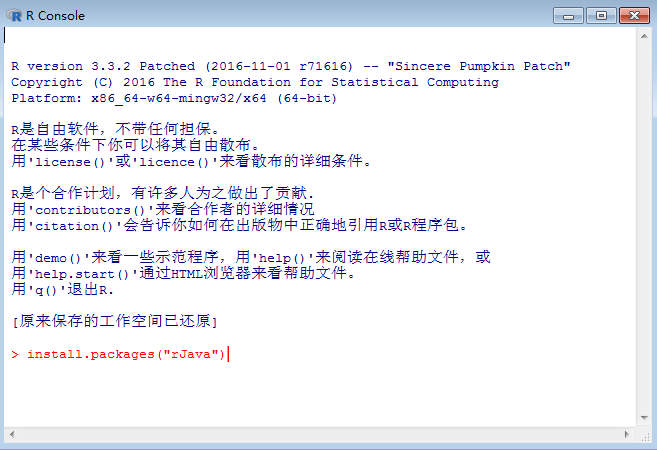

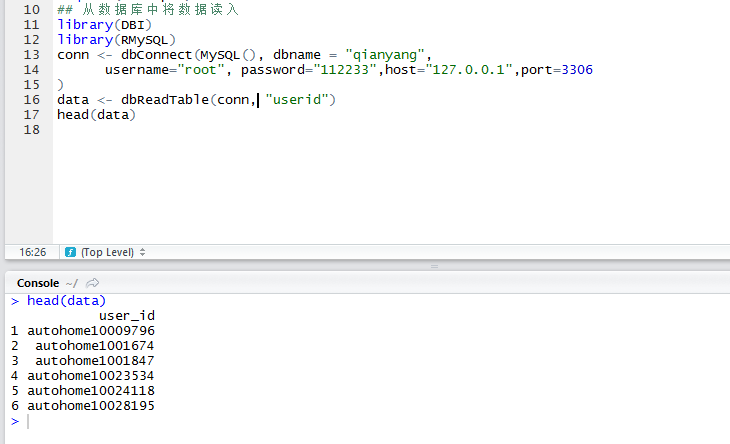

R的数据库连接、操作

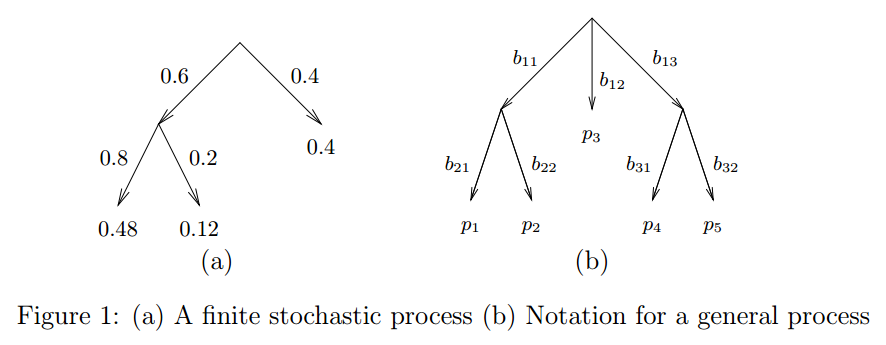

Dirichlet Process and Stick-Breaking(DP的Stick-breaking 构造)

使用Tensorflow的高级API - tf.contrib.learn 搭建一个DNN分类器

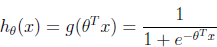

监督学习中的分类问题和Logistic回归常常被用于推荐问题中关于BPR的研究,但是为什么一定要用Logistic函数来建模和优化呢?本篇博客将带你揭晓奥秘~

R与java调用

狄利克雷分布作为多项式分布的先验大家应该比较熟悉了。这里介绍另外一种Dirichlet树结构的分布,也可以作为多项式分布的先验,但却更加灵活

linux环境下使用中文分词工具

狄利克雷过程混合模型(Dirichlet Process Mixture Model, DPMM)是一种非参数贝叶斯模型,它可以理解为一种聚类方法,但是不需要指定类别数量,它可以从数据中推断簇的数量。这篇博客将描述该模型及其求解过程。

使用R语言进行数据分析时,我们经常会遇到实验结果输出的问题,例如使用summary函数时,变量太多,控制台输出的结果不全,那么怎么将结果导出呢?

R语言如何根据抽样得到训练集与测试集

R语言操作数据库

本文是Steffen Rendle的文章BPR: Bayesian Personalized Ranking from Implicit Feedback的译文