DeepSeek LLM 7B Chat - DeepSeek LLM 7B Chat

模型详细情况和参数

DeepSeek LLM 7B Chat

- 模型全称

- DeepSeek LLM 7B Chat

- 模型简称

- DeepSeek LLM 7B Chat

- 模型类型

- 聊天大模型

- 发布日期

- 2023-11-29

- 预训练文件大小

- 13.82GB

- 是否支持中文(中文优化)

- 是

- 最高支持的上下文长度

- 4K

- 模型参数数量(亿)

- 70.0

- 模型代码开源协议

- MIT License

- 预训练结果开源商用情况

- DEEPSEEK LICENSE AGREEMENT - 免费商用授权

- 模型GitHub链接

- https://github.com/deepseek-ai/DeepSeek-LLM

- 模型HuggingFace链接

- https://huggingface.co/deepseek-ai/deepseek-llm-7b-chat

- 在线演示地址

- 暂无

- 基础模型

- 无基础模型

- 发布机构

DeepSeek LLM 7B Chat 简介

DeepSeek LLM 7B Chat是DeepSeekAI开源的一个大语言模型,是基于DeepSeek LLM 7B Base版本做聊天优化对齐得到的版本。DeepSeekAI是中国知名私募幻方量化旗下的一个人工智能大模型企业。

DeepSeek LLM 7B Chat是他们开源的一个70亿参数版本的大语言模型,其效果与LLaMA2-7B差不多。但是中文任务评测结果明显好于LLaMA2-7B。DeepSeek LLM模型本身包含了四个版本,2个参数规模等级,分别是7B和67B,而模型本身区分Base版本的基座模型和对话调优的Chat版本。

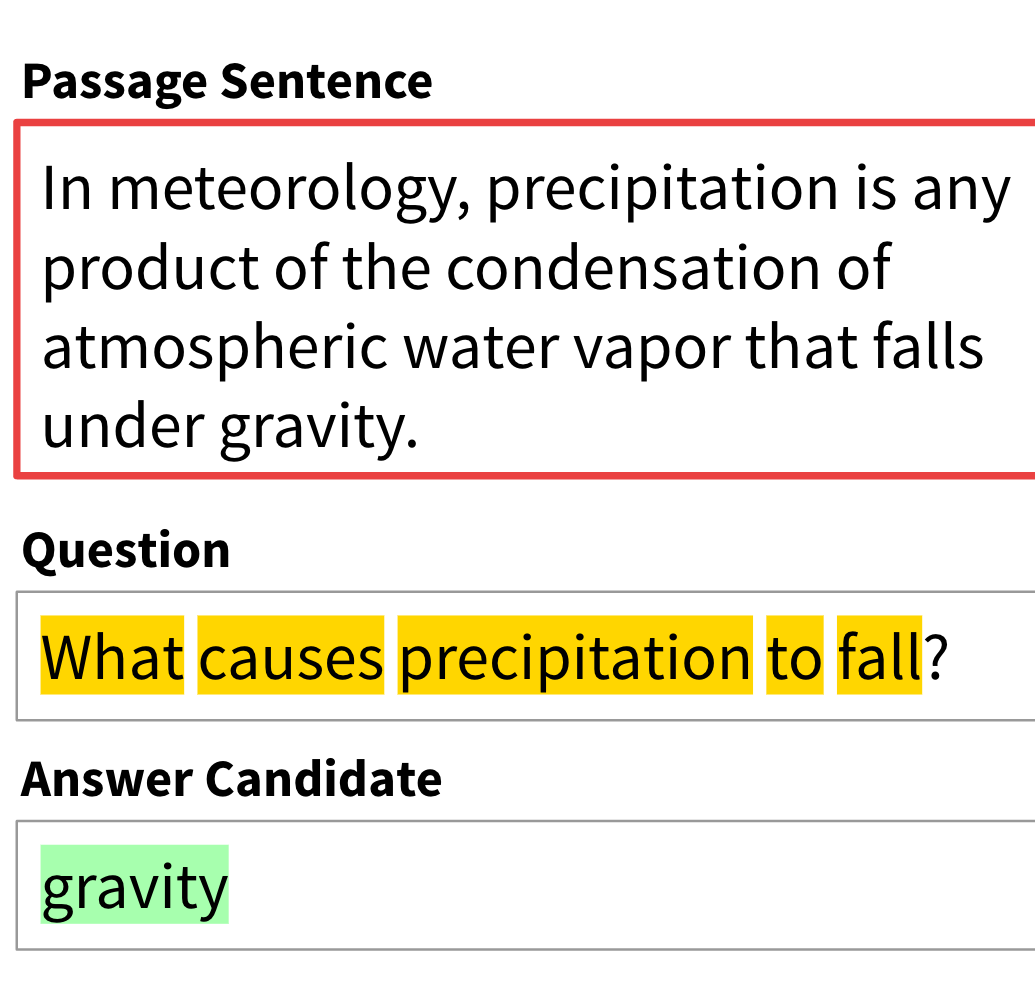

DeepSeek LLM 7B Chat这里说的是70亿参数的聊天优化的版本。DeepSeekLLM四个版本的评测数据如下:

| Model | TriviaQA | MMLU | GSM8K | HumanEval | BBH | C-Eval | CMMLU | ChineseQA |

|---|---|---|---|---|---|---|---|---|

| DeepSeek LLM 7B Base | 59.7 | 48.2 | 17.4 | 26.2 | 39.5 | 45.0 | 47.2 | 78.0 |

| DeepSeek LLM 67B Base | 78.9 | 71.3 | 63.4 | 42.7 | 68.7 | 66.1 | 70.8 | 87.6 |

| DeepSeek LLM 7B Chat | 57.9 | 49.4 | 62.6 | 48.2 | 42.3 | 47.0 | 49.7 | 75.0 |

| DeepSeek LLM 67B Chat | 81.5 | 71.1 | 84.1 | 73.8 | 71.7 | 65.2 | 67.8 | 85.1 |

DeepSeek LLM 7B Base版本参考: https://www.datalearner.com/ai-models/pretrained-models/deepseek-llm-7b-base

欢迎大家关注DataLearner官方微信,接受最新的AI模型和技术推送

DeepSeek LLM 7B Chat所属的领域

DeepSeek LLM 7B Chat相关的任务