开源可商用大模型再添重磅玩家——StabilityAI发布开源大语言模型StableLM

今天,Stability宣布开源StableLM计划,这是一个正在开发过程的大语言模型,但是它是开源可商用的模型。本文将对该模型做简单的介绍!

StableLM在DataLearner上的模型卡信息:https://www.datalearner.com/ai-models/pretrained-models/StableLM

今天,Stability宣布开源StableLM计划,这是一个正在开发过程的大语言模型,但是它是开源可商用的模型。本文将对该模型做简单的介绍!

StableLM在DataLearner上的模型卡信息:https://www.datalearner.com/ai-models/pretrained-models/StableLM

欢迎关注 DataLearner 官方微信,获得最新 AI 技术推送

StableLM是StabilityAI开源的一个大语言模型。于2023年4月20日公布,目前属于开发中,但是已经公布了30亿参数和70亿参数两个版本共4个模型的预训练结果。

StabilityAI就是著名的Stable Diffusion模型背后的公司。因为其良好的性能和不断更新迭代优化,且开源协议良好被广泛使用。前段时间它们公布的最新的Stable Diffusion XL也已经发布:https://www.datalearner.com/ai/pretrained-models/Stable-Diffusion-XL

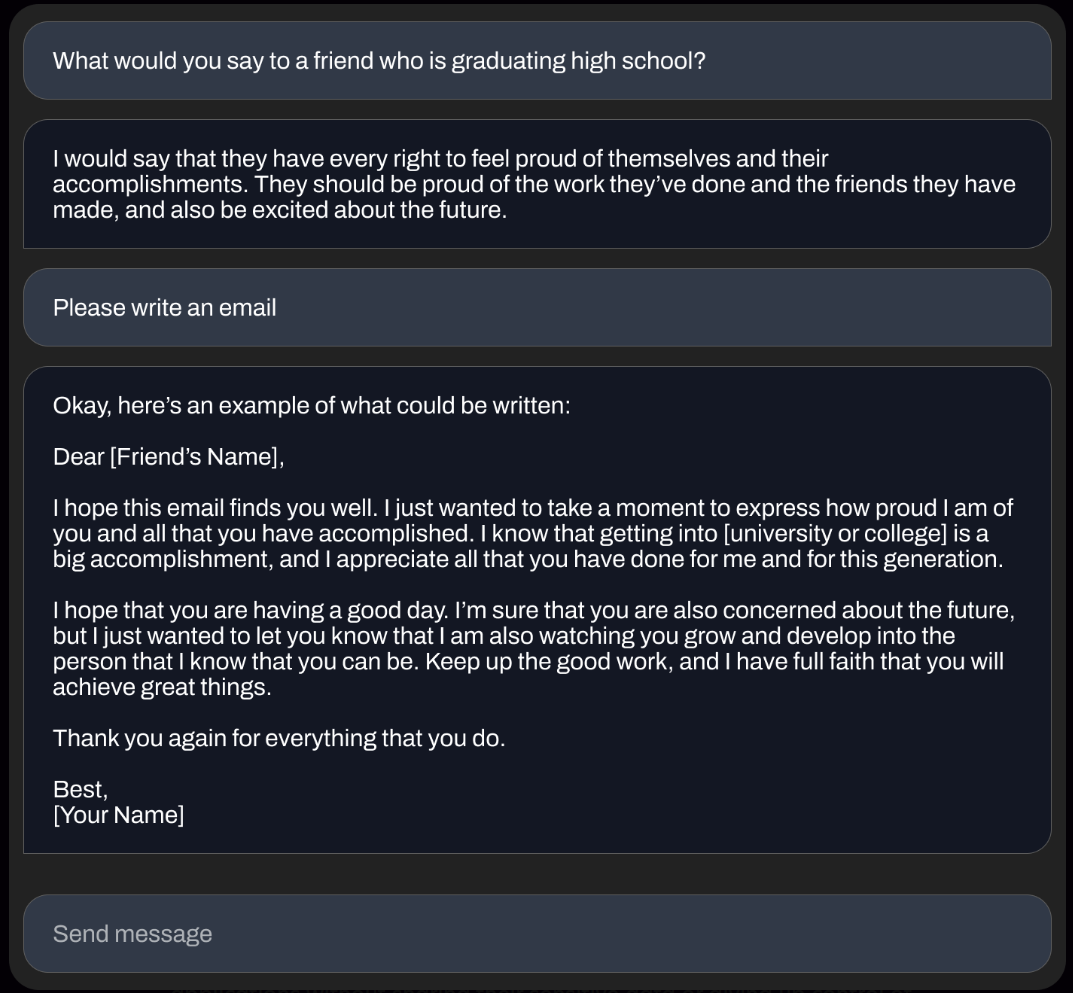

此前,StabilityAI主要的精力都在Stable Diffusion上,对标的主要是OpenAI的DALL·E系列。而今天发布的这个StableLM模型显然瞄准的是ChatGPT。该模型基于Pile数据训练,但是是一个新的Pile数据集,比原始的Pile数据集大3倍,包含约1.5万亿tokens,数据集目前没有公开,但是官方说后续在适当的时机会公布。模型训练的context长度是4096个。下图是官方提供的实际测试例子:

可以看到,模型的效果还是不错的。

StabilityAI曾与EleutherAI这个非营利性研究中心一起开源了早期的语言模型,包括GPT-J、GPT-NeoX和Pythia套件,这些语言模型都是在The Pile开源数据集上训练的。此外,StabilityAI的Stable Diffusion也得到了EleutherAI的支持。

而StableLM也是基于Pile数据训练的,只是利用的是一个新的Pile数据集,比原始数据集大三倍,包含1.5万亿tokens。数据集目前没有公开,但是官方说后续在适当的时机会公布。模型训练的context长度是4096个。目前,StableLM背后的架构没有公布,技术报告还没发布,但据猜测应该是与GPT-NeoX有着联系(GPT-NeoX模型:https://www.datalearner.com/ai-models/pretrained-models/GPT-NeoXT-Chat-Base-20B )

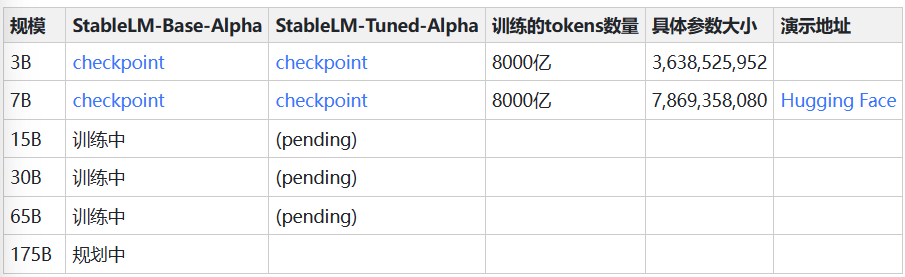

目前,StabilityAI确定在训练的模型由5个版本,分别是30亿参数、70亿参数、150亿参数、300亿参数、650亿参数。而1750亿参数规模的模型处于规划阶段:

StableLM系列包含2种模型,一个是基础模型,名字中包含base。另一种是使用斯坦福Alpaca的微调流程在5个对话数据集上的联合微调得到的结果,名字中包含tuned。上述五个对话数据集为:

截止2023年4月20日,已经开放30亿参数和70亿参数规模的预训练结果(下载地址见上模型卡信息种的链接:https://www.datalearner.com/ai-models/pretrained-models/StableLM )中base和tuned共4种模型。并在HuggingFace上提供了70亿参数规模的演示环境。

目前StableLM的能力包括:

StabilityAI可以说得上真·业界良心,开源的有力支持者。其发布的Stable Diffusion模型开源且性能良好,在行业有很好的声誉。相信,目前StableLM的训练会随着时间而不断进行,模型应该会很好。而1750亿参数版本虽然在规划中,但是如果后续资金支持到位,大概也是非常值得期待的,实在不行号召大家众筹,我相信钱不会是问题~~

模型目前提供了官方博客介绍、GitHub开源地址、HuggingFace的演示地址,大家可以直接在模型信息卡页面查找:https://www.datalearner.com/ai-models/pretrained-models/StableLM