用stata做倾向值分析和匹配

倾向值分析;stata; propensity score matching using stata

聚焦人工智能、大模型与深度学习的精选内容,涵盖技术解析、行业洞察和实践经验,帮助你快速掌握值得关注的AI资讯。

倾向值分析;stata; propensity score matching using stata

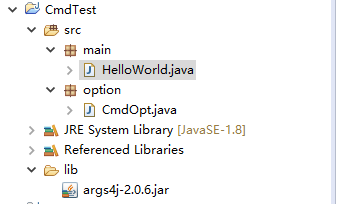

使用eclipse打包java工程并导出java包