ChatGPT的强有力挑战者HuggingChat发布——速度很快,不过水平略差~~

HuggingFace是近几年最火热的AI社区,在短短几年时间里已经称为AI模型的GitHub。目前,HuggingFace上已经托管了18万多的模型、3万多的数据集以及4万多的模型demo(spaces)。今天,HuggingFace发布了HuggingChat,声称要做最好的开源AI Chat项目,并且对所有人开放。

HuggingChat简介

根据官方介绍,HuggingChat的目标是做一个最好的开源的AI Chat应用。是基于开源的OpenAssistant模型开发的,其参数规模300亿。

OpenAssistant也是一个开源大模型,基于MetaAI开源的LLaMA微调得到(OpenAssistant分为好几个版本,目前有基于LLaMA微调的结果、基于Pythia微调的结果和基于StableLM微调的结果三个,HuggingChat的v0采用的是LLaMA版本的OpenAssistant:https://www.datalearner.com/ai-models/pretrained-models/OpenAssistant-LLaMA )。

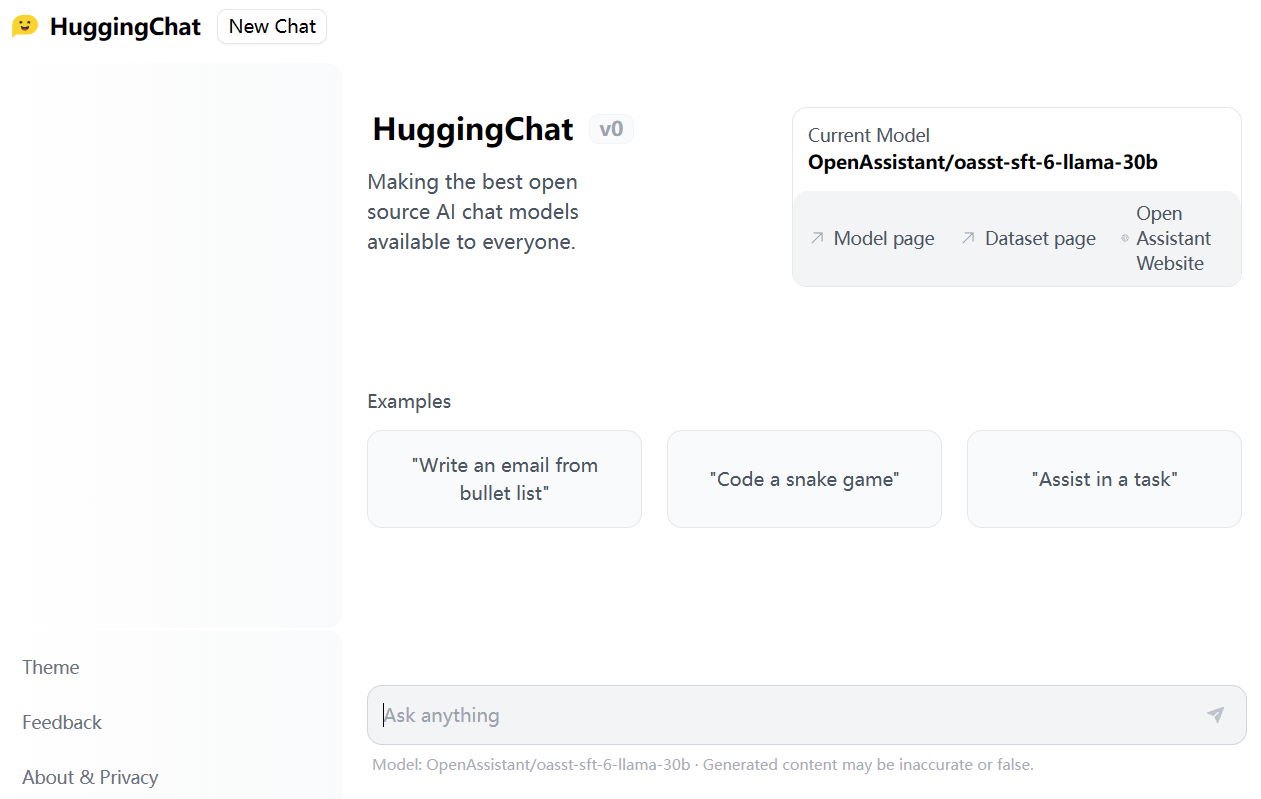

目前是v0版本,不需要账号就可以访问,而且不会记录用户的数据,使用界面非常清爽,如下图示:

这个应用程序运行在一个 Space 中,这意味着此 UI 的代码是开源的:https://huggingface.co/spaces/huggingchat/chat-ui/tree/main 。推理后端在 HuggingFace 的推理 API 基础设施上运行文本生成推理。

未来,HuggingChat将开放用户设置等。意味着可能需要账户才能使用并保存会话历史。目前,如果你更换浏览器,历史记录就没了。

HuggingChat的性能和效果

从目前大家的测试看,HuggingChat最大的特点是不需要账户就可以使用且速度很快。不过,目前可能由于访问流量过大也产生了不稳定的情况。

上面也就是出现了2个单词后没了后续的内容。

不过从测试结果看,效果时好时坏。我们看几个实测案例:

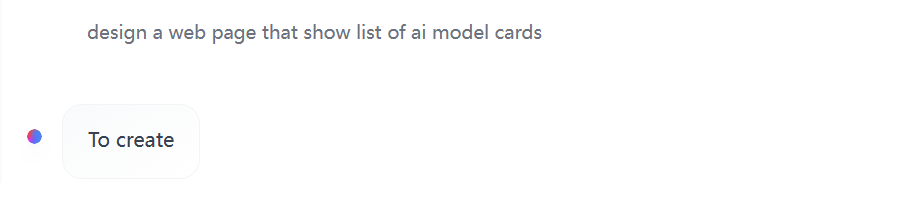

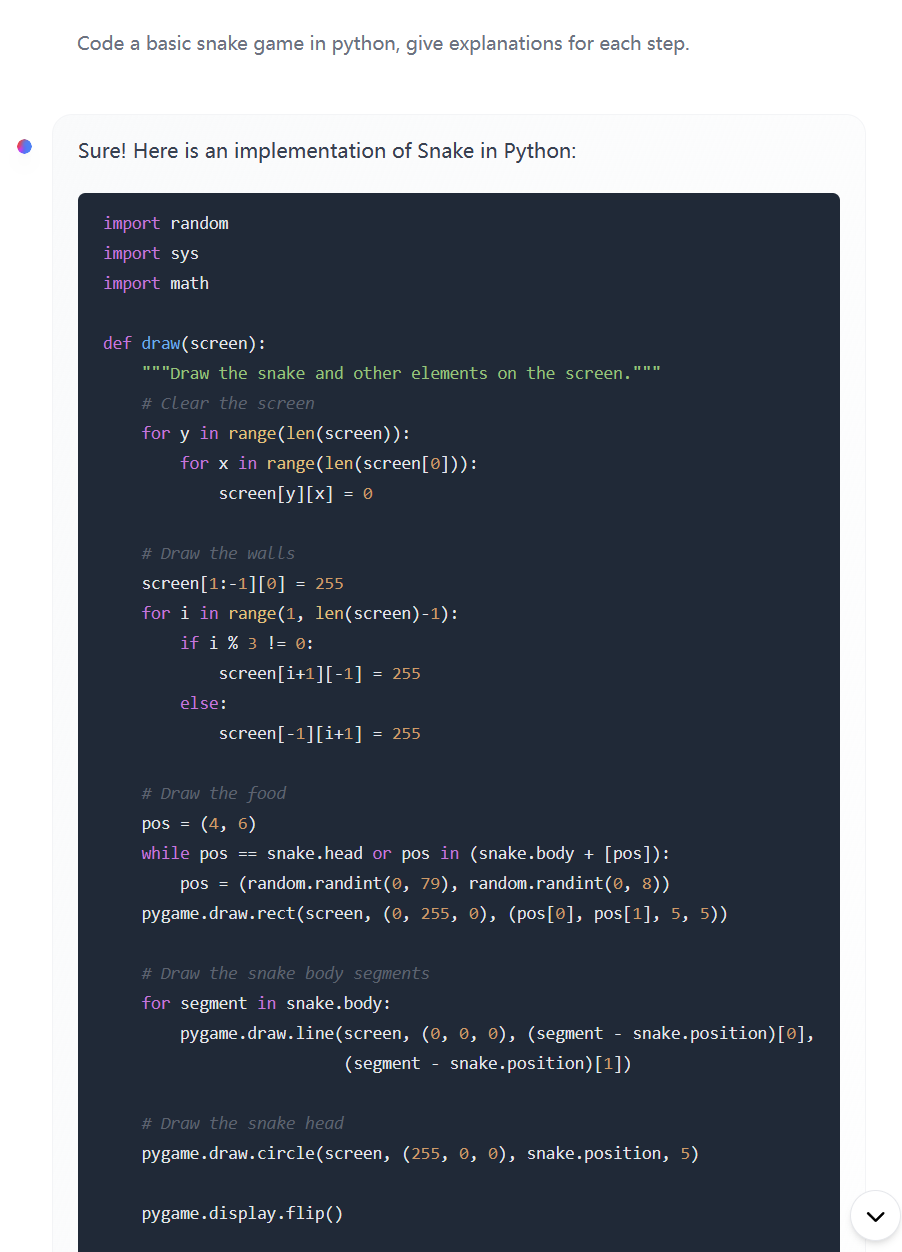

生成markdown的AI模型

可惜的是markdown没有换行。

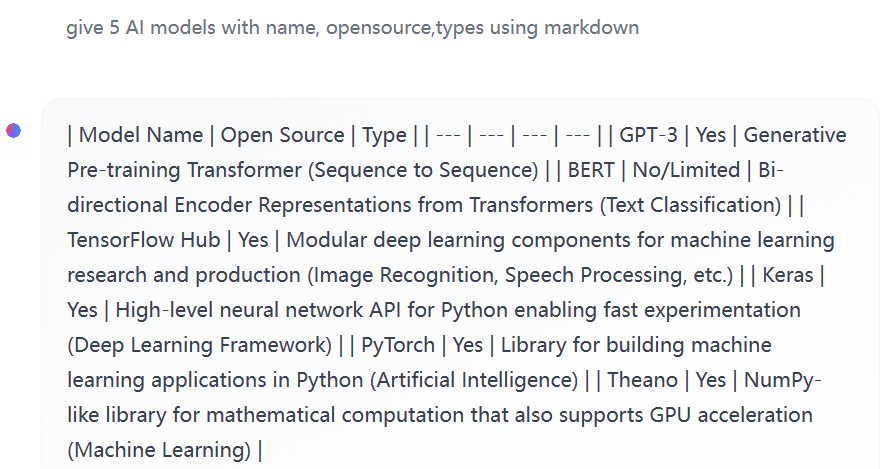

用python画一条蛇

代码生成了很多,但是因为长度限制,没有搞完。

中文支持

只能说,牛头不对马嘴~

总结

HuggingChat是目前Hugging官方提供的一个AI Chat系统,估计如果之前微软没有发布HuggingGPT(HuggingGPT信息:https://www.datalearner.com/blog/1051680273827206 ),那么它的名字可能就不是HuggingChat了!。从官方宣传的结果看,这个系统将会以开源的形式继续发展。但是,目前系统的能力实在是比较差。尽管它背后是300亿参数的模型,但是很多时候比人家70亿参数还差。我认为也比不上清华大学的ChatGLM-6B。不过它的优点是不需要账号,速度也很快。希望后续的模型迭代可以让它的能力更好,我觉得只要能达到GPT-3.5还开源的话,那就不得了了。

HuggingChat地址:https://huggingface.co/chat