重磅!谷歌开源Gemini同源技术大模型Gemma,分别为70亿参数和20亿参数,同等规模参数评测极其优秀!

Google Gemini是谷歌最新推出的和OpenAI竞争的大语言模型。尽管Gemini褒贬不一,但是Gemini模型的影响力是巨大的。而现在更加令人激动的是谷歌开源了2个新的不同参数规模的模型,分别是Gemma 7B和Gemma 2B,其技术与Gemini模型一致。但是这两个开源模型完全公开,可以商用授权。

Gemma模型简介

Gemma模型是谷歌开源的大语言模型的名称。目前有2个不同参数规模的4个版本,分别如下:

Gemma系列模型与Gemini的技术同源,具体架构信息如下:

从这个架构可以看出,Gemma模型的词汇表达到了25万!非常高。此外,Gemma还采用了一系列新技术,包括Multi-Query Attention、RoPE Embeddings、GeGLU激活函数以及Normalizer Location等。Gemma 2B模型在2万亿tokens数据集上训练,而Gemma 7B则是在7万亿数据集上训练。数据集主要是英语为主的网络文档、数学数据以及代码数据。但是,与Gemini不同的是,Gemma只是一个语言模型,没有多模态的能力。也没有多语言的能力。但是,两个指令微调版本的Gemma都有做RLHF对齐。

这两个模型的上下文长度都是8K。

Gemma的评测结果:70亿参数MMLU得分最高

谷歌官方宣称Gemma模型达到了同等规模参数最好的语言模型水平,甚至超过了某些参数量更大规模的模型。

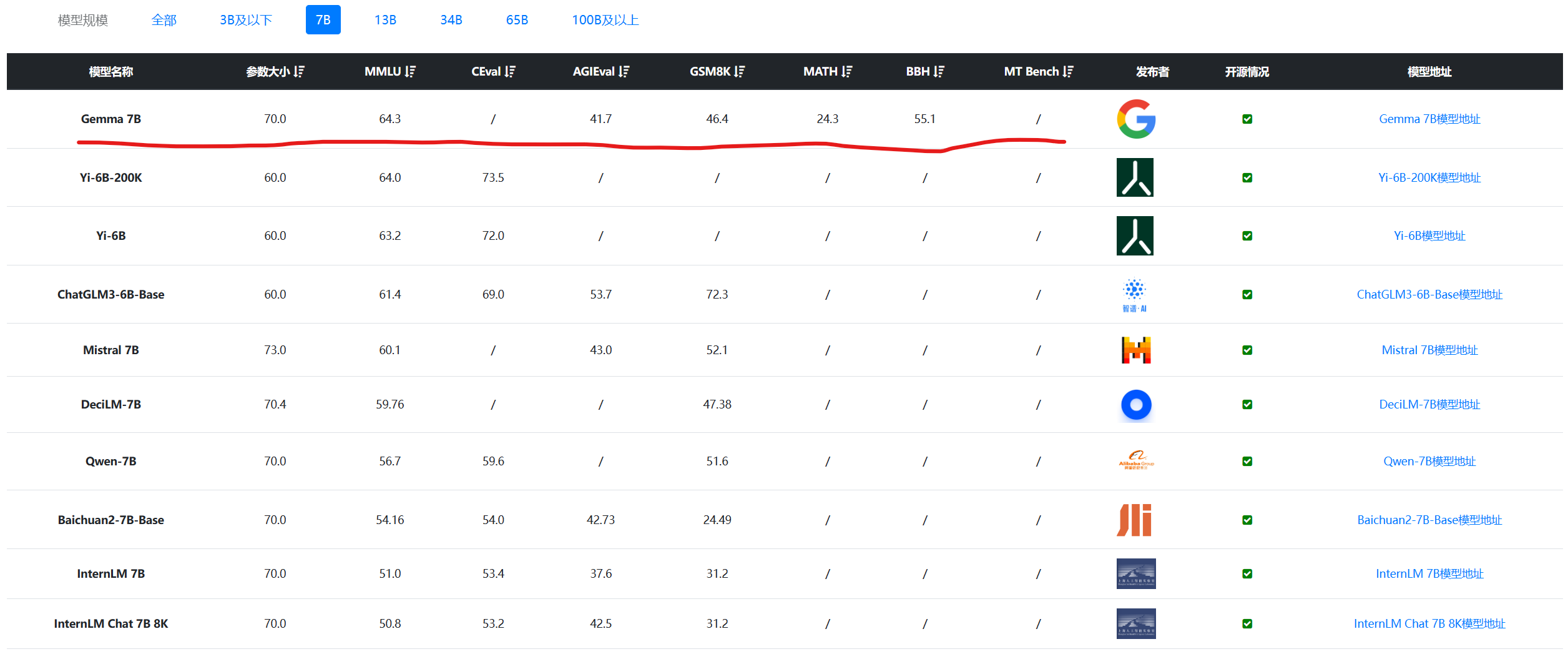

下图是DataLearnerAI的大模型评测结果的截图,都是70亿参数规模的模型。

上图是按照MMLU排序,并且都是70亿参数规模的结果。可以看到Gemma2 7B是MMLU得分最高的。这个分数与马斯克的Grok差不多,也接近Qwen-14B的水平。就变成评测HumanEval来说,Gemma 7B与CodeLlama 7B差不多。

从这个结果看,Gemma是非常优秀的开源领域70亿参数的大模型,综合评测和代码能力水平都是同等规模参数模型最强的。也超过了Mistral 7B的水平。

Gemma的开源情况

Gemma是谷歌开源的模型,是一个完全自定义的开源协议。从协议内容看应该是允许商用授权的。

除了这个商用授权协议外,Google此次开源最大的特点是提供了非常丰富的工具和生态。具体如下:

- 通过Keras 3.0提供了JAX、PyTorch、TensorFlow推理和微调的工具链,这意味着支持主流的框架进行推理和微调

- 提供了Google Colab和Kaggle Notebooks的代码示例

- 支持HuggingFace、MaxText、Nvidia NeMO、TensorRT-LLM等加速框架

- 对Nvidia的GPU和Google的TPU都有针对性的优化

从这些内容看,本次Google开源的Gemma非常有诚意,不仅是模型能力很强,在生态和社区支持方面也非常好。关于模型具体的代码示例、预训练开源地址可以参考DataLearnerAI的模型信息卡。