StarCoder2发布,开源编程大模型又一个强大选择!

在近年来,随着人工智能技术的飞速发展,大型语言模型(LLM)在代码生成和编辑领域的应用越来越广泛,成为软件开发中不可或缺的助手。今天,我想向大家介绍一个由BigCode项目与Software Heritage合作开发的下一代代码大型语言模型——StarCoder 2。

StarCoder 2简介

StarCoder 2是一个开放科学合作项目,旨在负责任地开发用于代码生成的大型语言模型(Code LLMs)。这个项目通过结合Software Heritage的庞大源代码档案库,精心挑选了包括GitHub拉取请求、Jupyter和Kaggle笔记本以及代码文档等高质量数据源,构建了一个比首个StarCoder数据集大4倍的训练集。StarCoder 2模型具有3B、7B和15B三种参数规模,经过3.3至4.3万亿令牌的训练,全面评估了它们在一系列Code LLM基准测试上的性能。

数据来源与预处理

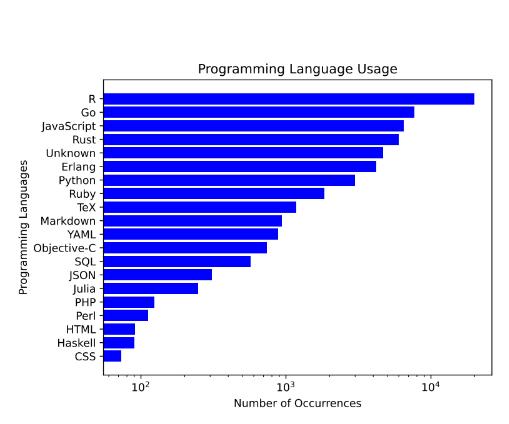

StarCoder 2项目涵盖了多种数据来源,包括源代码、GitHub问题、拉取请求、Jupyter和Kaggle笔记本、文档以及数学和编码挑战的特定数据集等。在数据预处理阶段,项目团队实施了去重、个人信息(PII)编辑、去污染、恶意代码移除以及处理开发者的退出请求等步骤,以确保数据的质量和安全性。