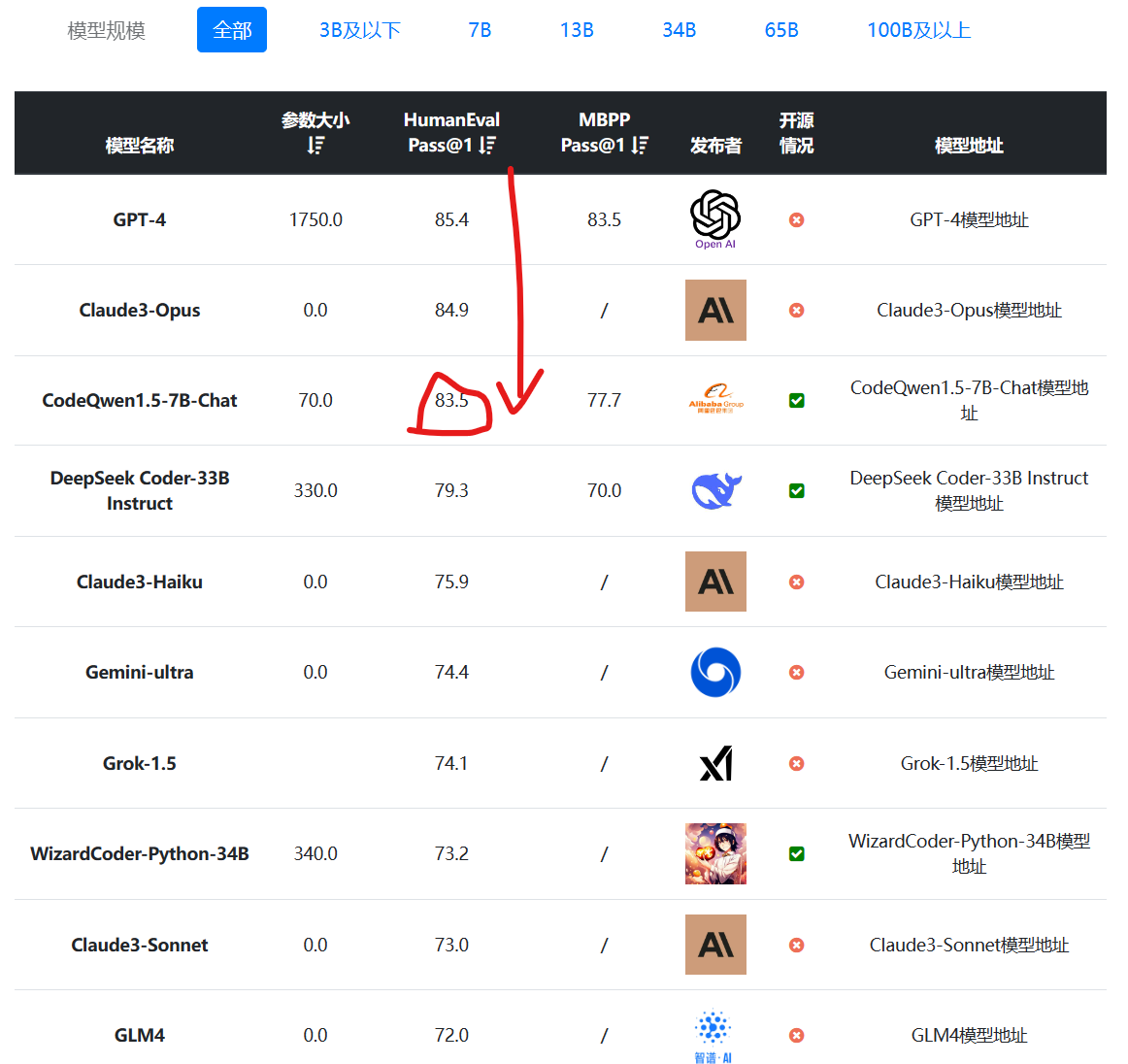

HumanEval评测接近GPT-4-Turbo!阿里巴巴开源70亿参数编程大模型CodeQwen1.5-7B!

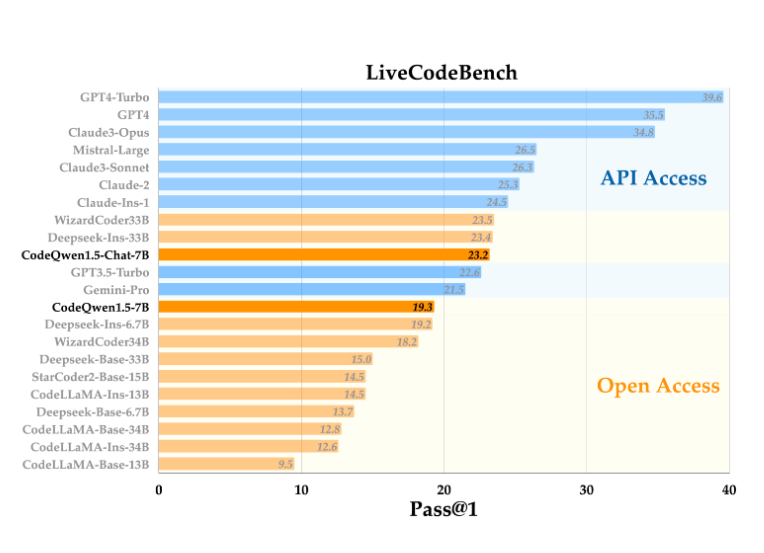

编程大模型是当前大语言模型里面最重要的一类。一般是基础大模型在预训练之后,加入代码数据集继续训练得到。在代码补全、代码生成方面一般强于常规的大语言模型。阿里最新开源的70亿参数大模型CodeQwen1.5-7B在HumanEval评测结果上超过了GPT-4早期版本(GPT-4发布的技术报告),表现异常地好!

CodeQwen1.5-7B模型简介

千问系列大语言模型是阿里巴巴开源的一系列大模型。最新的Qwen1.5系列是Qwen2的beta版本,比第一代的Qwen模型提升很多。由于开源协议友好,能力强大在开源领域受到非常广泛的关注。

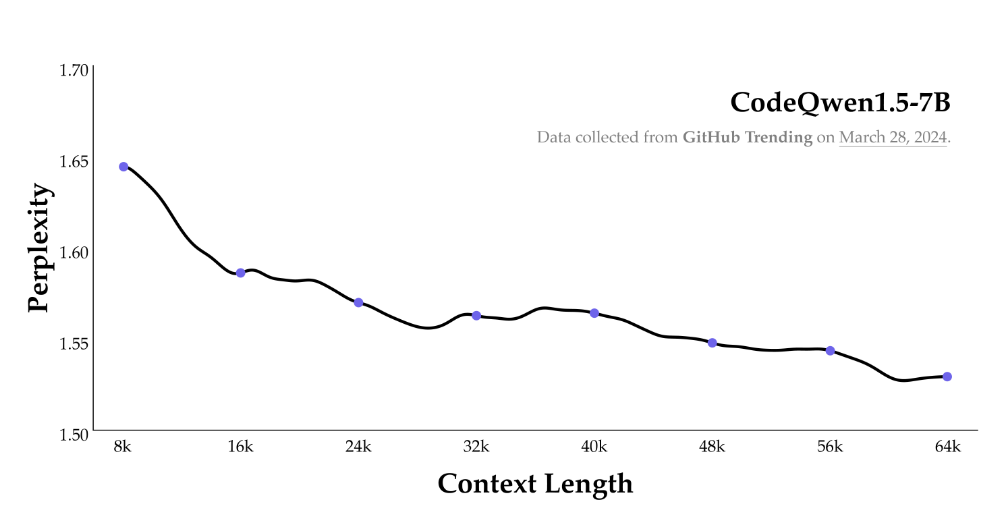

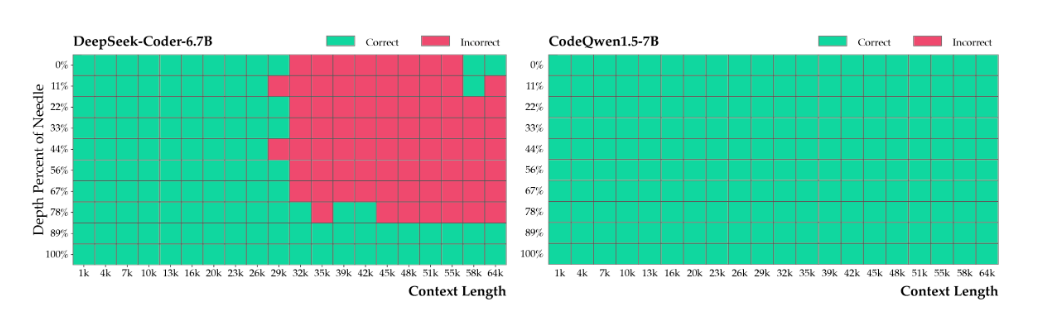

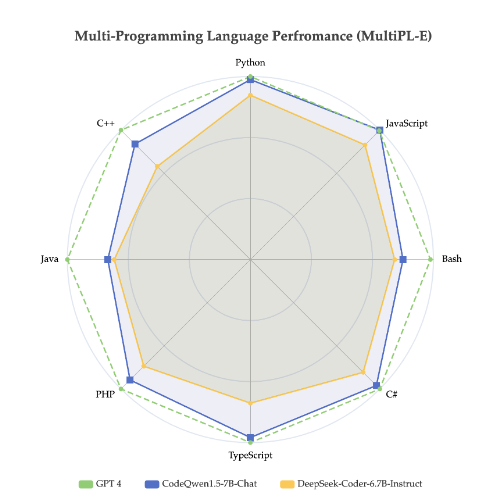

此前,Qwen1.5系列主要是不同参数规模的大语言模型(参考:重磅!第二代通义千问大模型开源,阿里巴巴一口气开源了30个不同参数规模的模型,其中Qwen1.5-72B仅次于GPT-4.)。这次开源的CodeQwen1.5-7B是千问系列首个针对编程优化的大语言模型,参数规模70亿。尽管参数量不大,但是评测结果表现非常优秀。