MistralAI发布全新编程大模型:24B开源Devstral Small 1.1在SWE-Bench Verified评分超过旧版DeepSeek R1,编程大模型新的替代

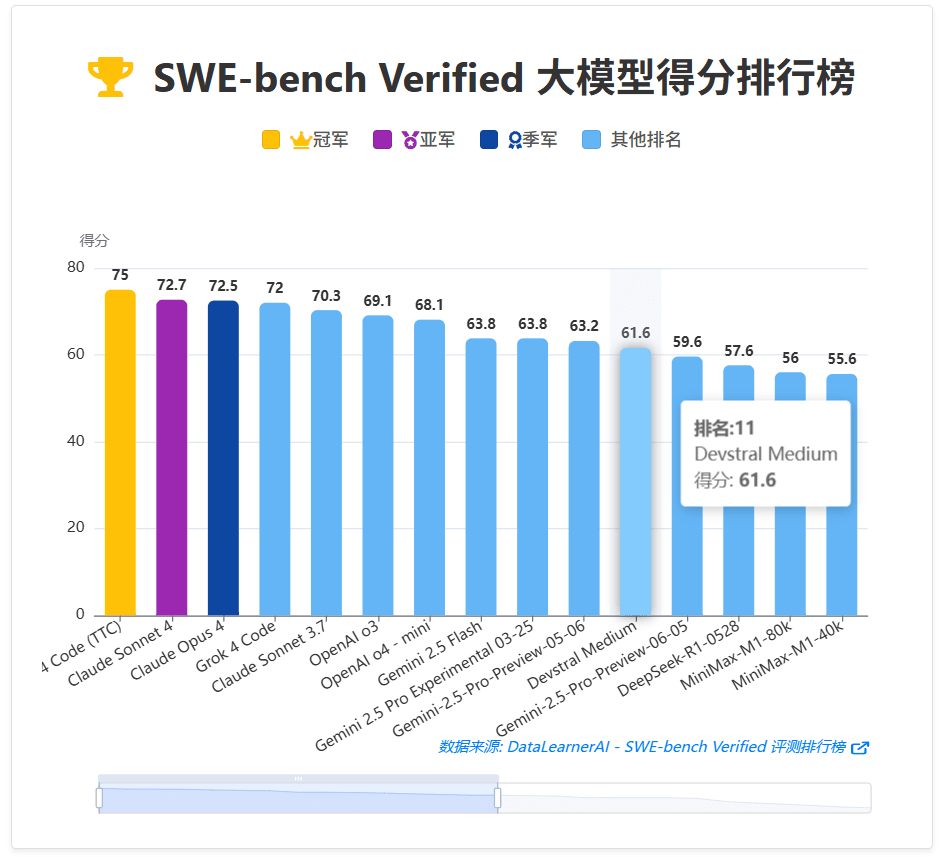

编程大模型一直是人工智能领域中进展最快的方向之一。因为编程能力更强的模型,通常在逻辑思维、工具调用上也有更好的表现,在很多领域,特别是Agent领域有很大的应用价值。今天,法国人工智能明星公司MistralAI发布了2个全新的编程大模型,分别是Devstral Medium和Devstral Small 1.1,后者是一个开源的240亿参数的编程大模型。

Devstral Small 1.1:竞争力极强的开源新选择

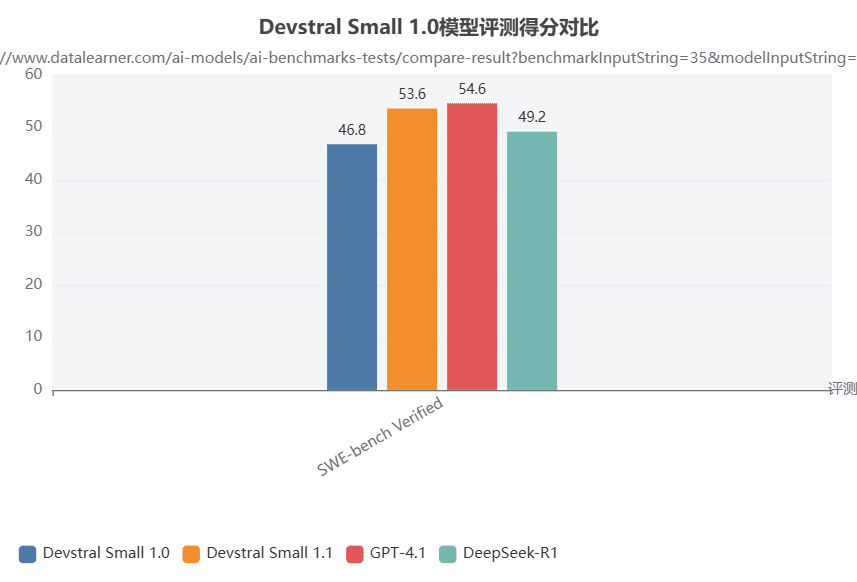

Devstral Small 1.1是一个开源的、参数量为240亿、针对编程任务优化的的大模型。在2024年5月,MistralAI已经开源了Devstral Small 1.0版本,仅2个月后的今天,Devstral Small 1.1就迎来了更新。相较于1.0版本,,可以说进步非常明显。