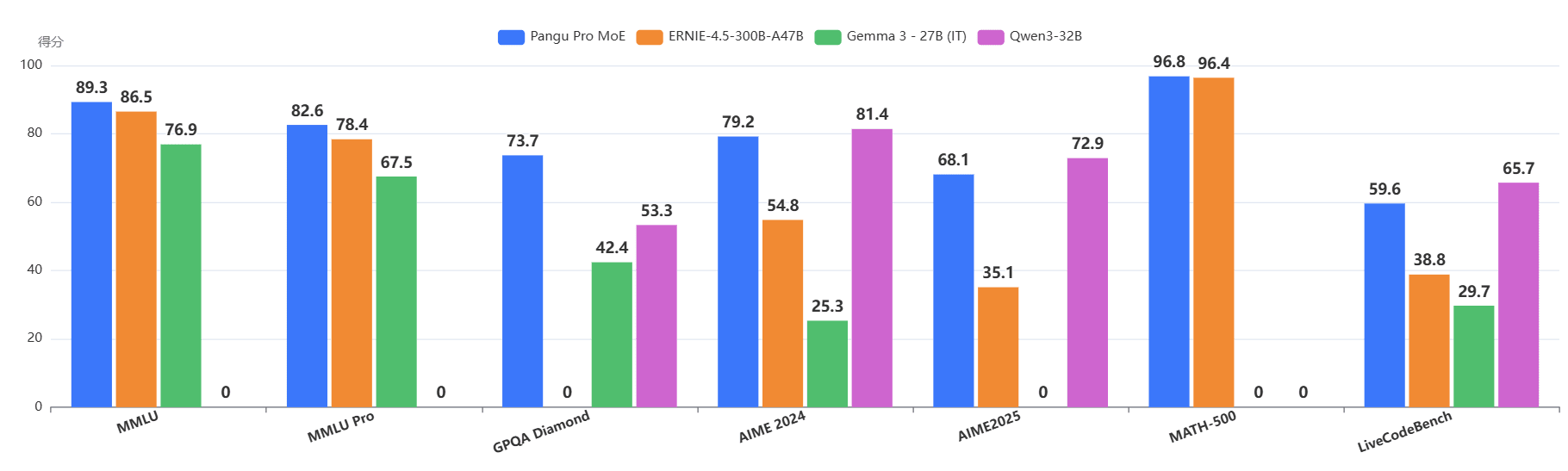

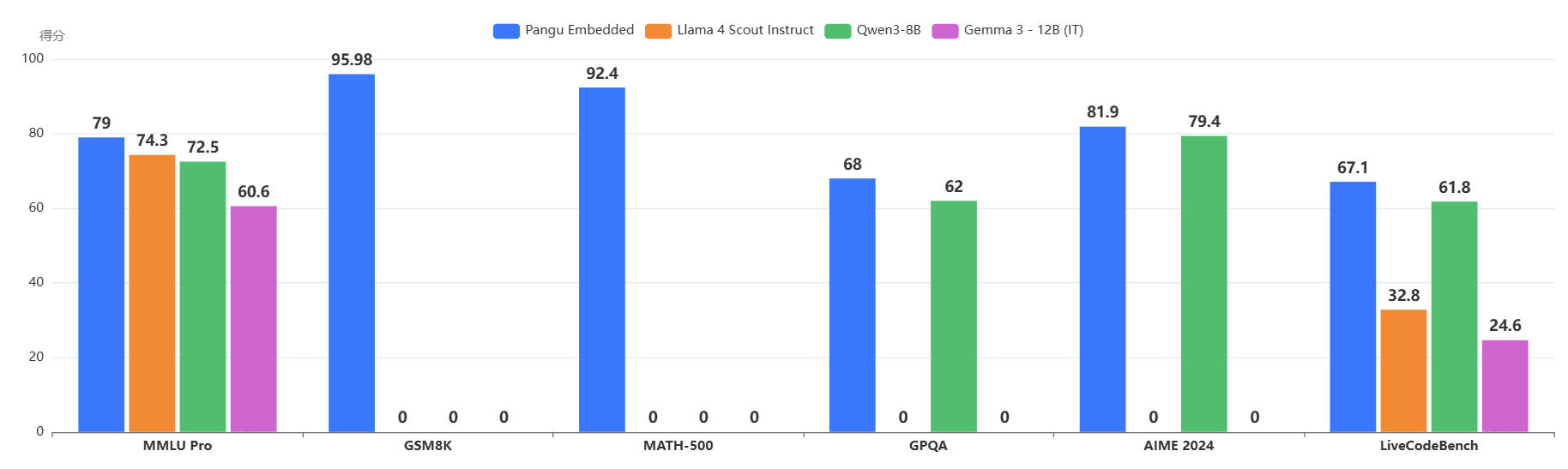

华为开源2个Pangu大模型:分别是MoE架构,720亿总参数,160亿激活参数的Pangu Pro MoE以及Pangu Embedded,评测结果略超同级别的Qwen3

盘古大模型是华为自研的大语言模型,基于华为的硬件和技术栈进行训练。此前一直被认为是国产技术占比很高的国产大模型。今天,华为开源了2个盘古大模型,分别是MoE架构的Pangu Pro MoE模型以及70亿参数规模的Pangu Embedded模型。

这两个模型均是大语言模型,前者是MoE架构的大模型,后者是一个稠密的70亿参数大模型,虽然叫Embedded但是是推理大语言模型。