重磅!Kimi K2.5发布,依然免费开源!原生多模态MoE架构,全球最大规模参数的开源模型之一,官方评测结果比肩诸多闭源模型!可以驱动100个子Agent执行!

2026年1月27日,月之暗面(Moonshot AI)发布新一代模型Kimi K2.5。根据官方说明,这是Kimi K2的后续版本,目前已通过Kimi.com网页端和App向用户推送。该模型同步上线Kimi API开放平台及编程助手Kimi Code,模型权重与相关代码也在Hugging Face开源。

2026年1月27日,月之暗面(Moonshot AI)发布新一代模型Kimi K2.5。根据官方说明,这是Kimi K2的后续版本,目前已通过Kimi.com网页端和App向用户推送。该模型同步上线Kimi API开放平台及编程助手Kimi Code,模型权重与相关代码也在Hugging Face开源。

欢迎关注 DataLearner 官方微信,获得最新 AI 技术推送

Kimi K2.5采用混合专家架构(Mixture-of-Experts, MoE),总参数量1万亿,单次前向传播激活320亿参数。模型基于约15万亿混合视觉与文本token进行继续预训练。看了一下HF上的模型文件大模型,有595GB,基本上告别了普通用户和小企业了。

另外,K2.5架构层面包含61层网络(1层Dense连接层与60层MoE层),配备384个专家网络(每token路由至8个专家加1个共享专家),支持长达256K tokens的上下文窗口,并采用MoonViT视觉编码器处理图像和视频输入。

API定价为:输入token缓存命中0.10美元/百万token,未命中0.60美元/百万token,输出token 3.00美元/百万token。总体而言比较便宜。

官方强调,本次开源的Kimi K2.5最大的更新有2个:原生的多模态理解和Agent群功能。

原生的视觉与编程整合 Kimi K2.5是一个原生的多模态大模型,且编程很强。它支持从UI截图、视频流直接生成前端代码,实现"视觉编程"(Coding with Vision)。官方示例显示其可复现视频中的网页交互效果,并支持动态布局与滚动动画生成。

智能体群(Agent Swarm) 智能体群(Agent Swarm)是该版本引入的新范式(传闻Claude Code也即将引入)。基于并行智能体强化学习(PARL)算法,模型可自主拆解任务并动态生成最多100个子智能体,并行执行最多1500次工具调用。据官方数据,相比单智能体执行,该方式可减少最高4.5倍的执行时间。

这个能力还是很强的,如果100个子Agent执行都能驱动很好,且支持上千次工具调用。那么复杂任务场景的可落地性将大幅提升。

此外,官方还强调Kimi K2.5在办公生产力方面的能力,K2.5支持对Word、Excel、PPT、PDF等文档的端到端处理,包括金融建模、LaTeX公式编写、长文档撰写等功能。

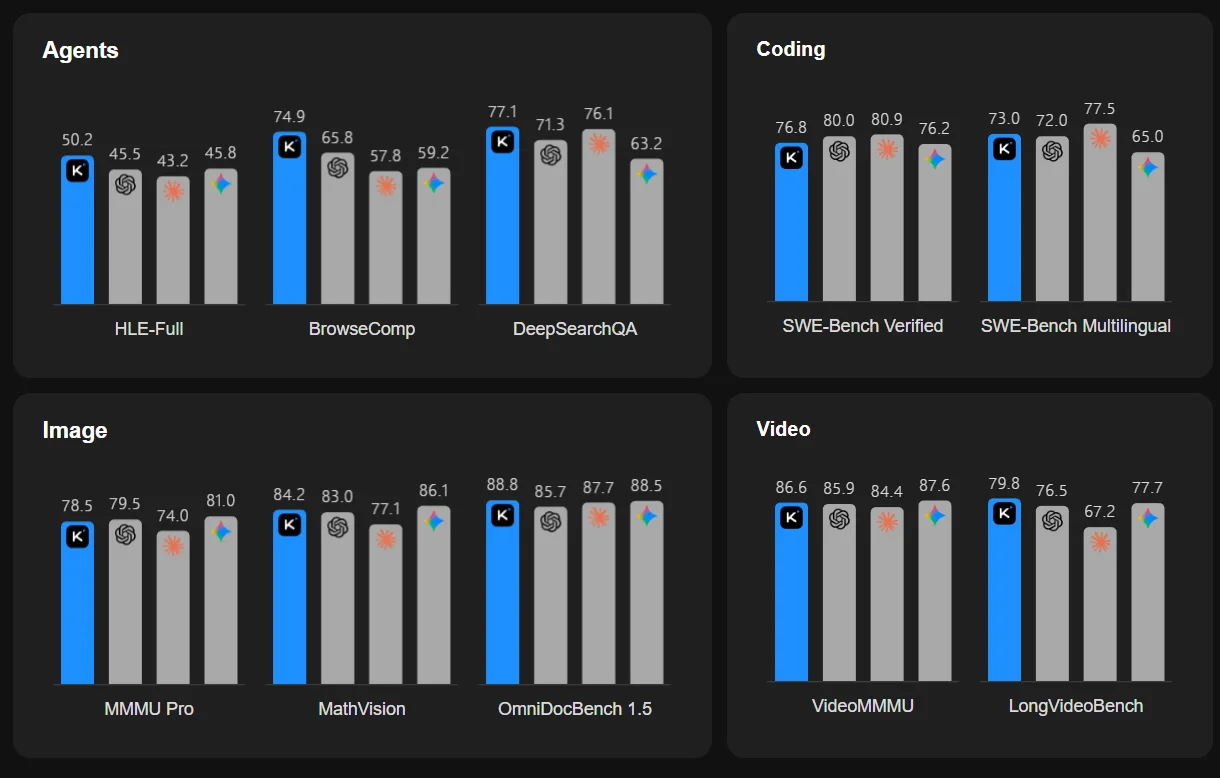

在评测数据方面,Kimi K2.5 展现了超越当前顶尖开源模型的实力,甚至在部分指标上优于闭源模型。下图是官方给出的部分评测结果截图:

Kimi K2.5的完整评测也可以参考DataLearnerAI的模型信息卡:https://www.datalearner.com/ai-models/pretrained-models/kimi-k2-5

根据官方披露的基准测试结果,在衡量智能体综合能力的 **HLE-Full(Humanity's Last Exam)**带工具评测中,Kimi K2.5 取得了 50.2 的高分,超过了 GPT-5.2 (xhigh) 的 45.5 分(这个分数也超过了今天刚发布的Qwen3-Max-Thinking的正式版本,它的带工具的HLE得分是49.8分,差一点点)。

在浏览器网页行为评测BrowseComp上,得分74.9,远超其它模型。需要注意这是OpenAI的评测基准,GPT-5.2 xhigh模式也就65.8分。这个数据表明Kimi K2.5的浏览器使用应该很强。不过在比较著名的实际编程测评SWE-Bench Verified评测上,Kimi K2.5得分76.8分,与最强的闭源模型,如Claude 4.5的80.9分的差距还是明显的。不过这个得分已经超过了Gemini 3.0 Pro了!

在数学推理 AIME 2025 测试中,其得分高达 96.1。在视觉能力上,它在 MMMU-Pro 和 VideoMMMU 等榜单上也表现优异。此外,在 SWE-Bench Verified 等代码生成评测中,K2.5 也凭借其视觉辅助编程能力取得了领先成绩,证明了其在处理真实世界软件工程任务时的可靠性。

Kimi K2.5是月之暗面对前代模型的更新版本,虽然版本号是0.5个版本,但是评测的得分还是明显的。而且X上很多人反馈说它的输出质量很高。我们DataLearnerAI几个文本输出任务上发现,它的文本更加符合实际的情况,不那么浮夸,至少个体感受上好过GPT-5.2了。最重要的,这个模型依然完全免费商用授权(需要注意的是它是修改版的MIT协议,如果这个模型的软件或其衍生作品被用于「月活 >1 亿」或「月收入 >2 000 万美元」的商业产品/服务,是需要获取授权的。),不过普通用户也部署不起,成本太高了。完整部署需要好多个满血版H100或者H200了。

Kimi K2.5主要在多模态理解、编程能力与智能体协作方面进行了改进。Kimi K2.5的开源地址和完整的评测信息参考DataLearnerAI的Kimi K2.5的模型信息卡:https://www.datalearner.com/ai-models/pretrained-models/kimi-k2-5