大模型的发展速度很快,对于需要学习部署使用大模型的人来说,显卡是一个必不可少的资源。使用公有云租用显卡对于初学者和技术验证来说成本很划算。DataLearnerAI在此推荐一个国内的合法的按分钟计费的4090显卡公有云服务提供商仙宫云,可以按分钟租用24GB显存的4090显卡公有云实例,非常具有吸引力~

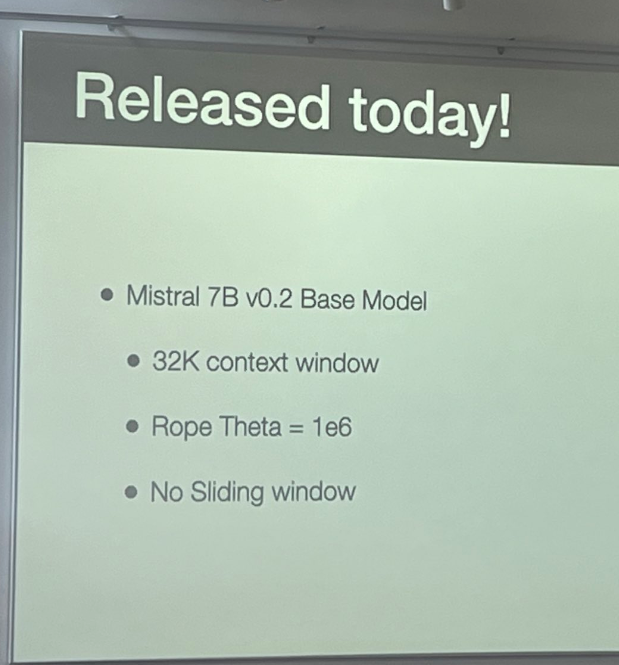

Mistral-7B是由MistralAI开源的一个73亿参数规模的大语言模型,最早在2023年9月底开源。因为其良好的性能和友好的开源协议被很多人使用。今天,这个模型升级到来v0.2版本Mistral-7B-v0.2。基于Mistral-7B-v0.2进行指令微调的模型 Mistral-7B-Instruct-v0.2在2023年11月11日公布,而这个基座模型则是在2023年3月24日开源。

今日推荐

OpenAI即将推出DALL·E Controls功能,可以更加精细化控制DALL·E图片生成的效果

平衡二叉树之红黑树(Red-Black Tree)简介及Java实现

文本理解与代码补全都很强!Salesforce开源支持8K上下文输入的大语言模型XGen-7B!

Seq2Seq的建模解释和Keras中Simple RNN Cell的计算及其代码示例

如何训练一个大语言模型?当前基于transformer架构的大语言模型的通用训练流程介绍

CerebrasAI开源可以在iPhone上运行的30亿参数大模型:BTLM-3B-8K,免费可商用,支持最高8K上下文输入,仅需3GB显存

Hugging Face发布最新的深度学习模型评估库Evaluate!