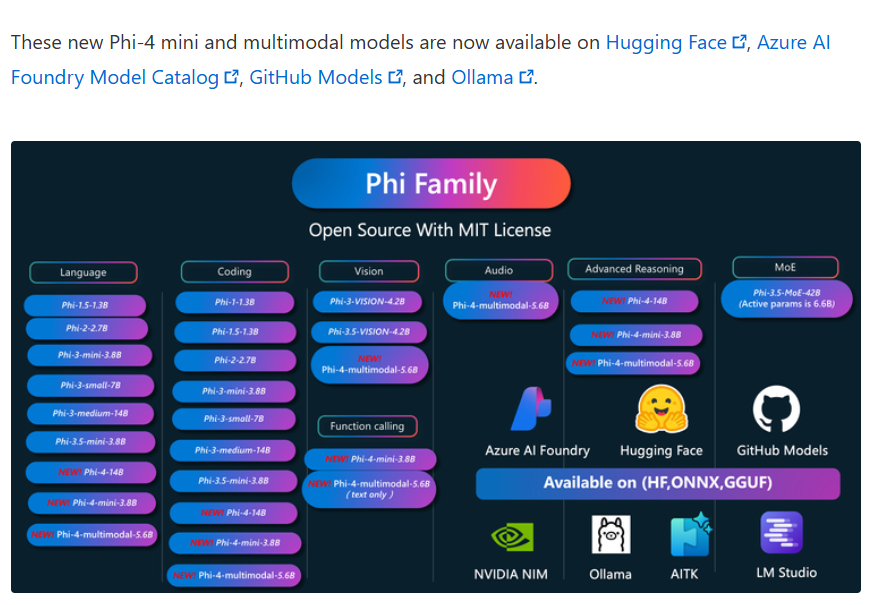

微软开源最强38亿小规模参数大语言模型以及56亿参数规模全模态大模型,但是总体评测结果超过Qwen2.5-7B以及Llama3.1-8B等模型,接近GPT-4o mini。

2025年2月27日,微软正式发布了其全新系列的大型语言模型——Phi-4系列。这一系列包含了三个创新性的模型:Phi-4-Mini、Phi-4-Multimodal和一款经过推理优化的Phi-4-Mini。此次发布的模型不仅在性能上展现出色,更在多模态能力与推理任务中实现了显著突破。其中,Phi-4-Multimodal是一个仅仅包含56亿参数规模的多模态大模型,但是支持文本、语音、图片的输入,十分强大。