Google最新超大模型Pathways:一个会讲笑话的6400亿参数的语言模型

去年,谷歌研究院宣布了一个新的Pathways的愿景,一个可以跨领域和任务通用的单一模型,同时具有很高的效率。实现这一愿景的一个重要里程碑是开发新的Pathways系统来协调加速器的分布式计算。

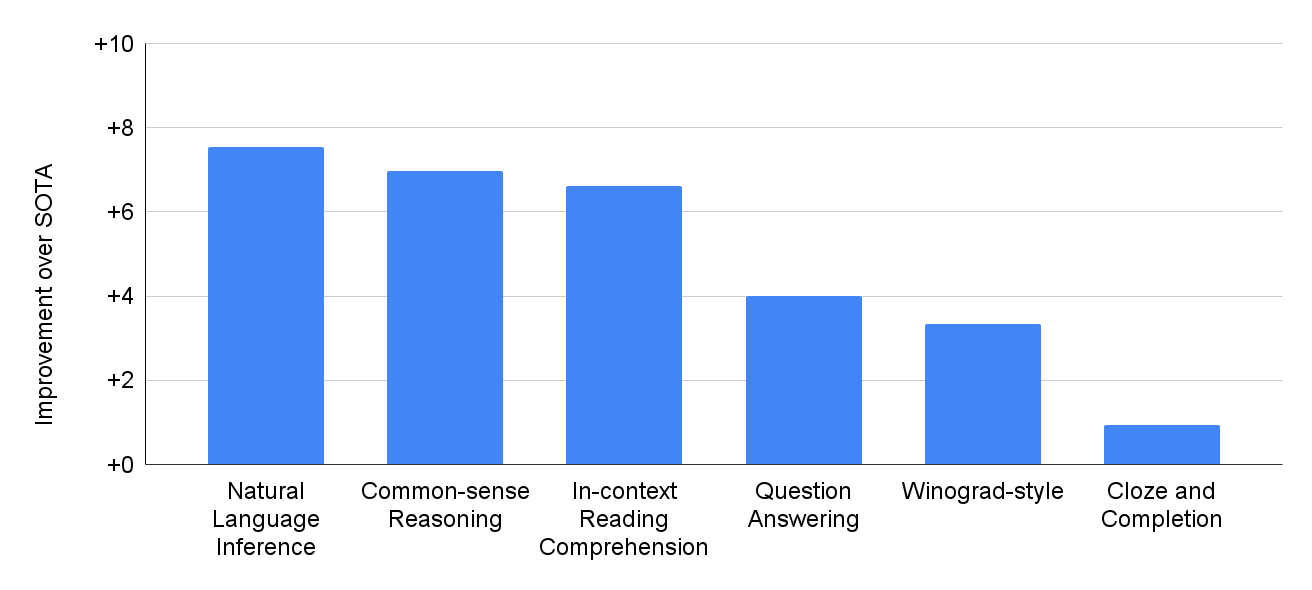

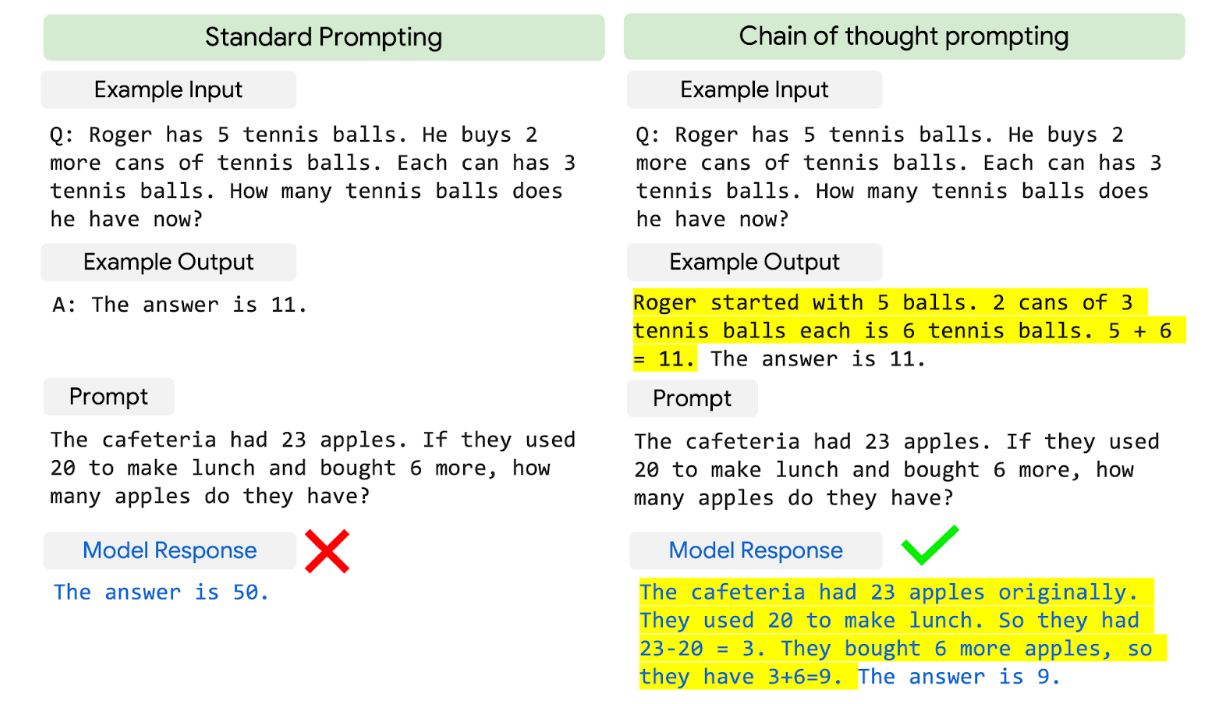

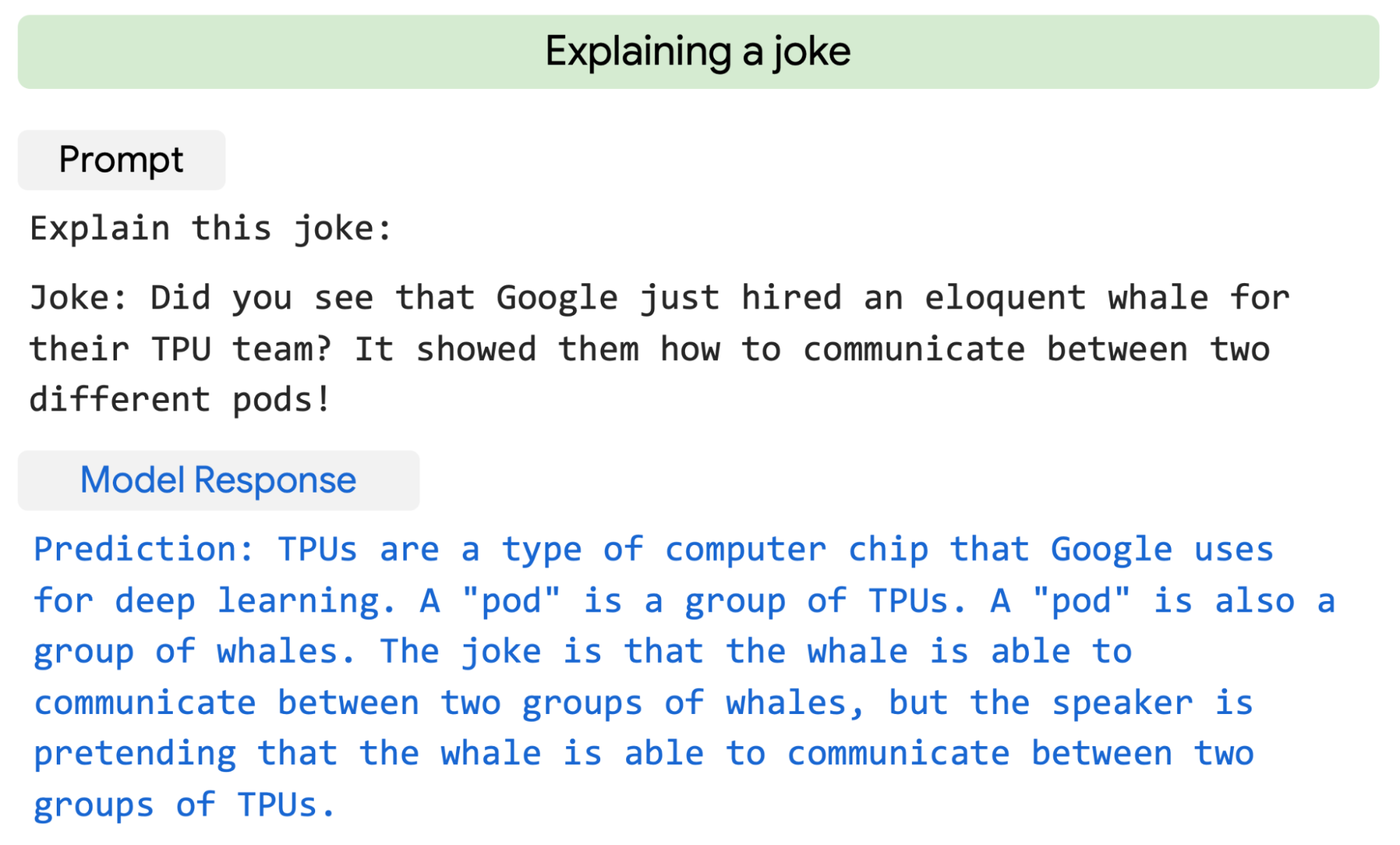

今天,Google介绍了一个新的语言模型,一个Pathways语言模型:PaLM,这是一个用Pathways系统训练的5400亿个参数、仅有dense decoder的Transformer模型,在数百个语言理解和生成任务上对PaLM进行了评估,发现它在大多数任务中实现了最先进的性能,在许多情况下都有显著的优势。