统计、机器学习与编程知识的原创博客

聚焦人工智能、大模型与深度学习的精选内容,涵盖技术解析、行业洞察和实践经验,帮助你快速掌握值得关注的AI资讯。

最新博客

LiveCodeBench:全面的 LLM 代码评测基准基准

LiveCodeBench 由加州大学伯克利分校、麻省理工学院和康奈尔大学的研究人员开发,是一个先进的评测基准套件,专门用于严格评估大语言模型 (LLMs) 在代码处理方面的能力,并解决现有基准测试的局限性。通过引入实时更新的问题集和多维度评估方法,LiveCodeBench 确保对 LLM 进行公平、全面和稳健的评估。

Keras框架下的保存模型和加载模型

Keras框架下的保存模型和加载模型

TensorFlow学习——基本概念(1)

TensorFlow基本概念

Microsoft Visual C++ 14.0 is required 的解决方案

Microsoft Visual C++ 14.0 is required

如何对向量大模型(embedding models)进行微调?几行代码实现相关原理

大语言模型是通过收集少量专门数据对模型的部分权重进行更新后得到一个比通用模型更加专业的模型。但是,当前大家讨论较多的都是语言模型的微调,对于嵌入模型(或者向量大模型)的微调讨论较少。Modal团队的工作人员发布了一个博客,详细介绍了向量大模型的微调工作,本文将其翻译之后提供给大家(原文:https://modal.com/blog/fine-tuning-embeddings )。

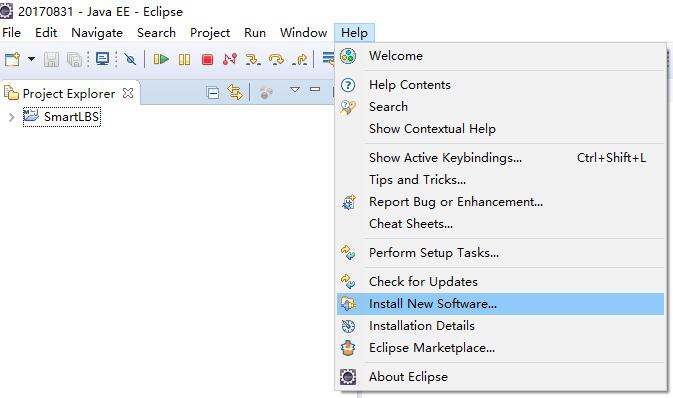

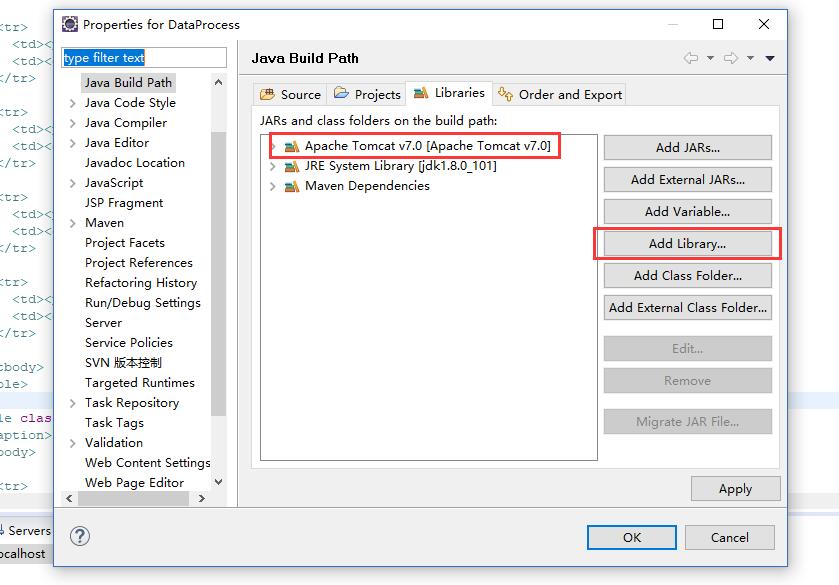

Eclipse安装SVN插件

使用SVN进行项目的版本管理是非常流行的操作,这篇博客将描述Eclipse安装SVN的方法。

《Effective Java 第三版》笔记之一 创建静态工厂方法而不是使用构造器

本文是Effective Java第三版笔记的第一个之创建静态工厂方法而不是使用构造器

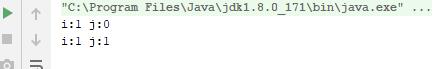

Java中自增操作i++与++i的区别

在Java中,自增是一种非常常见的操作,在自增中,有两种写法,一种是前缀自增(++i),一种是后缀自增(i++)。这里主要简单介绍两种自增的差别。

大数据环境下的处理系统与数据分析

随着互联网的高速发展,人类进入了一个信息爆炸的时代,每个人的生活都充满了结构化和非结构化的数据。另外,随着以博客、社交网络、基于位置的服务LBS为代表的新型信息发布方式的不断涌现,以及云计算、物联网技术的兴起,数据正以前所未有的速度在不断地增长和积累,数据已经渗透到当今每一个行业和业务职能领域成为重要的产生因素,以数据为驱动的大数据时代已经不可避免地到来。本文主要围绕大数据特征、处理系统、以及大数据分析来阐述大数据环境下的数据分析在思想、流程、方法等方面的转变,以及围绕此主题而出现的相关关键技术与方法。

python中Scrapy的安装详细过程

python中Scrapy的安装详细过程

帮助你提升知识和技能的17个数据科学项目(都是可以免费获取的)

数据科学项目为我们提供了很好的机会提升我们的技能和知识。这篇博客提供了17个数据科学的项目,都是可以免费获取的项目,大家可以通过这些诶项目学习数据科学相关知识。

如何让开源大模型支持ChatGPT的Code Interpreter能力:基于LangChain的开源项目Code Interpreter API

ChatGPT的Code Interpreter插件让ChatGPT突破了大语言模型本身只能做文本处理的限制,使其可以通过生成并执行Python代码来实现强大的数据分析、图片生成、视频数据处理等操作,大大拓展了ChatGPT的实用范围和价值。在此前的文章中,我们已经分析了Code Interpreter插件的官方实现。而今天,LangChain的官方博客也推出了一种类似的开源方案,让开源模型也可以实现ChatGPT的Code Interperter插件。我们简要描述一下这个方案。

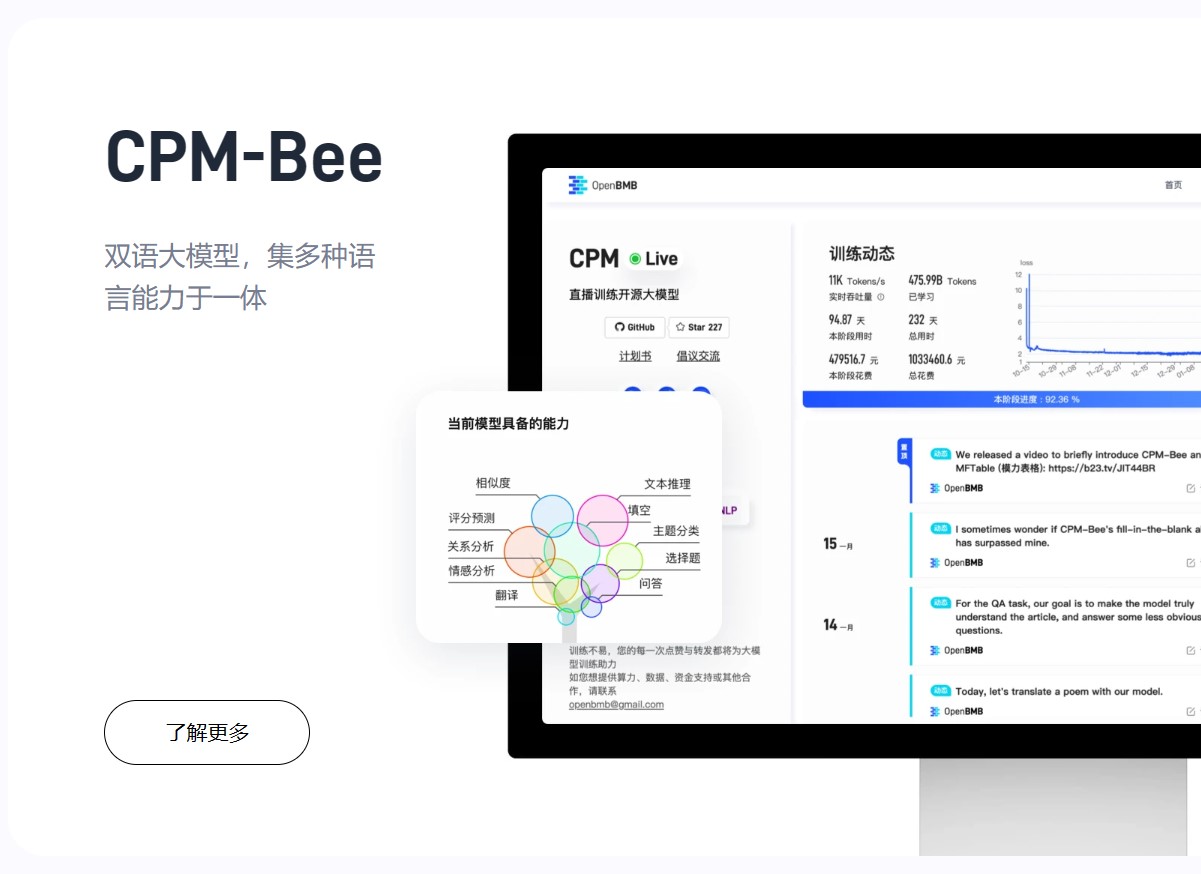

国产开源中文大语言模型再添重磅玩家:清华大学NLP实验室发布开源可商用大语言模型CPM-Bee

5月27日,OpenBMB发布了一个最高有100亿参数规模的开源大语言模型CPM-BEE,OpenBMB是清华大学NLP实验室联合智源研究院成立的一个开源组织。该模型针对高质量中文数据集做了训练优化,支持中英文。根据官方的测试结果,其英文测试水平约等于LLaMA-13B,中文评测结果优秀。

网络爬虫中的模拟登陆获取数据(实例教学)

网络爬虫中的模拟登陆获取数据

指标函数(Metrics Function)和损失函数(Loss Function)的区别是什么?

指标(metrics)和损失函数(loss function)在深度学习和机器学习里面非常常见,很多时候他们的公式都似乎是一样的,在编写程序的时候,二者的区别好像也不是很大。那为什么还会有这两种不同的概念出现呢?本文将简单介绍一下二者的区别和应用。

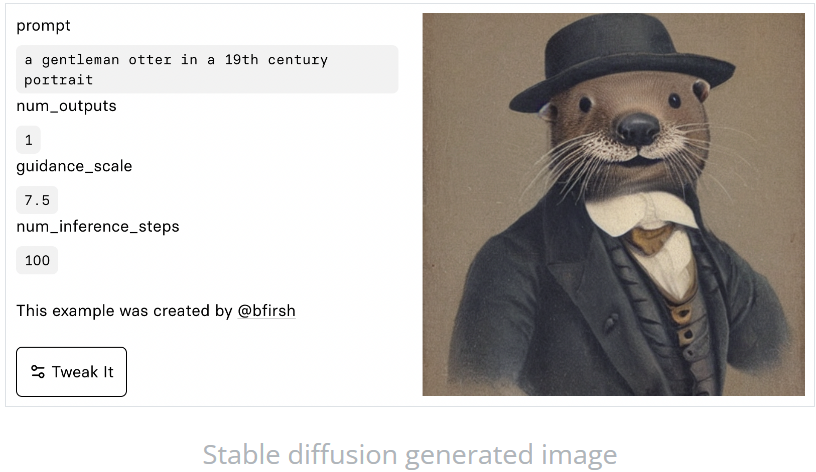

最新好课!从深度学习到stable diffusion的手把手入门教程

Stable Diffusion是最近很火的Text-to-Image预训练模型(详细信息:https://www.datalearner.com/ai-resources/pretrained-models/stable-diffusion )。而现在,相关的视频教程已经出现。fast.ai的团队宣布了一门新的深度学习课程《From Deep Learning Foundations to Stable Diffusion》上线!

eclispe常见错误及其解决方案

eclipse创建导入项目的时候经常会发生各种错误。本篇博客将讲述常见的错误及其解决方案。

“GPT”的模型太多无法选择?让大模型帮你选择大模型!浙江大学发布HuggingGPT!

随着ChatGPT的火爆以及MetaAI开源了LLaMA,各家公司好像一夜之间都有了各种ChatGPT模型的研发实力。而针对不同任务和应用构建的LLM更是层出不穷。那么,如何选择合适的模型完成特定的任务,甚至是使用多个模型完成一个复杂的任务似乎仍然很困难。为此,浙江大学与微软亚洲研究院联合发布了一个大模型写作系统HuggingGPT,可以根据输入的任务帮我们选择合适的大模型解决!

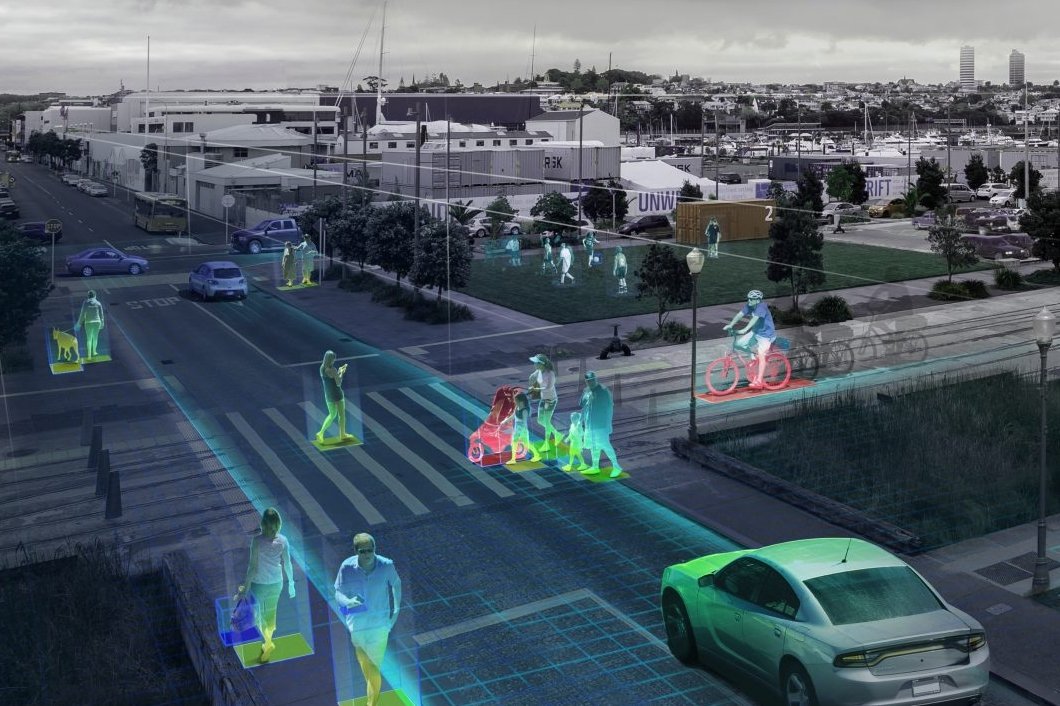

计算机视觉领域的六大任务简介

计算机视觉与自然语言处理是近几年人工智能领域进步最快以及应用最为成熟的两个方向。计算机视觉里面任务涉及面广,有很多细分领域,本文将对计算机视觉领域中比较常见的六种任务进行总结并同时展示以下相关任务的一些成绩。