MistralAI的混合专家大模型Mistral-7B×8-MoE详细介绍,效果超过LLaMA2-70B和GPT-3.5,推理速度快6倍

12月8日晚上,MistralAI在他们的推特账号上发布了一个磁力链接,大家下载之后根据名字推断这是一个混合专家模型(Mixture of Experts,MoE)(详情参考DataLearnerAI此前的介绍:MistralAI开源全球首个(可能)基于MoE(Mixture of Experts)技术的大模型:预训练下载链接全球直发,但实测表现似乎一般!)。这种模型因为较低的成本和更高的性能被认为是大模型技术中非常重要的路径。也是GPT-4可能的方案。MistralAI在今天发布了博客,正式介绍了这个强大的模型。

Mistral-7B×8-MoE的特点

根据官方的介绍,Mistral-7B×8-MoE是一个高质量稀疏型的专家混合模型。是8个70亿参数规模大模型的混合。它的主要特点如下:

- 它可以非常优雅地处理32K上下文数据

- 除了英语外,在法语、德语、意大利语和西班牙语表现也很好

- 在代码能力上表现很强

- 指令微调后MT-Bench的得分8.3分(GPT-3.5是8.32、LLaMA2 70B是6.86)

在MoE模型中,有两个关键组件:

-

专家(Experts):这些是网络中的小型子网络,每个专家通常专注于处理一种特定类型的数据或任务。专家的设计可以是多种形式,如完全连接的网络、卷积网络等。

-

门控机制(Gating Mechanism):这是一个智能路由系统,负责决定哪些专家应该被激活来处理当前的输入数据。门控机制基于输入数据的特性,动态地将数据分配给不同的专家。

官方介绍,这个模型是基于网络数据预训练的,其中,专家网络和门控路由是同时训练的。

Mistral-7B×8-MoE评估效果

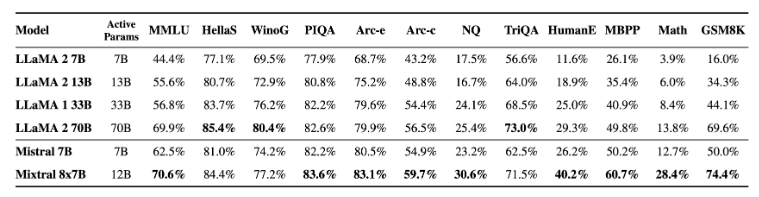

此次,官方详细公布了Mistral-7B×8-MoE在各个评测数据集上的评测效果。结果如下:

从这个角度看,Mistral-7B×8-MoE与GPT-3.5、LLaMA2-70B是一个水平的。

Mistral-7B×8-MoE和LLaMA系列更加详细的对比:

可以看到,Mistral-7B×8-MoE模型在各方面的指标都很不错,几乎与LLaMA2-70B在一个水平,但是由于每次只有120亿参数在工作,这意味着它的成本要远低于LLaMA2 70B,官方的说法是推理速度比LLaMA2 70B快6倍!

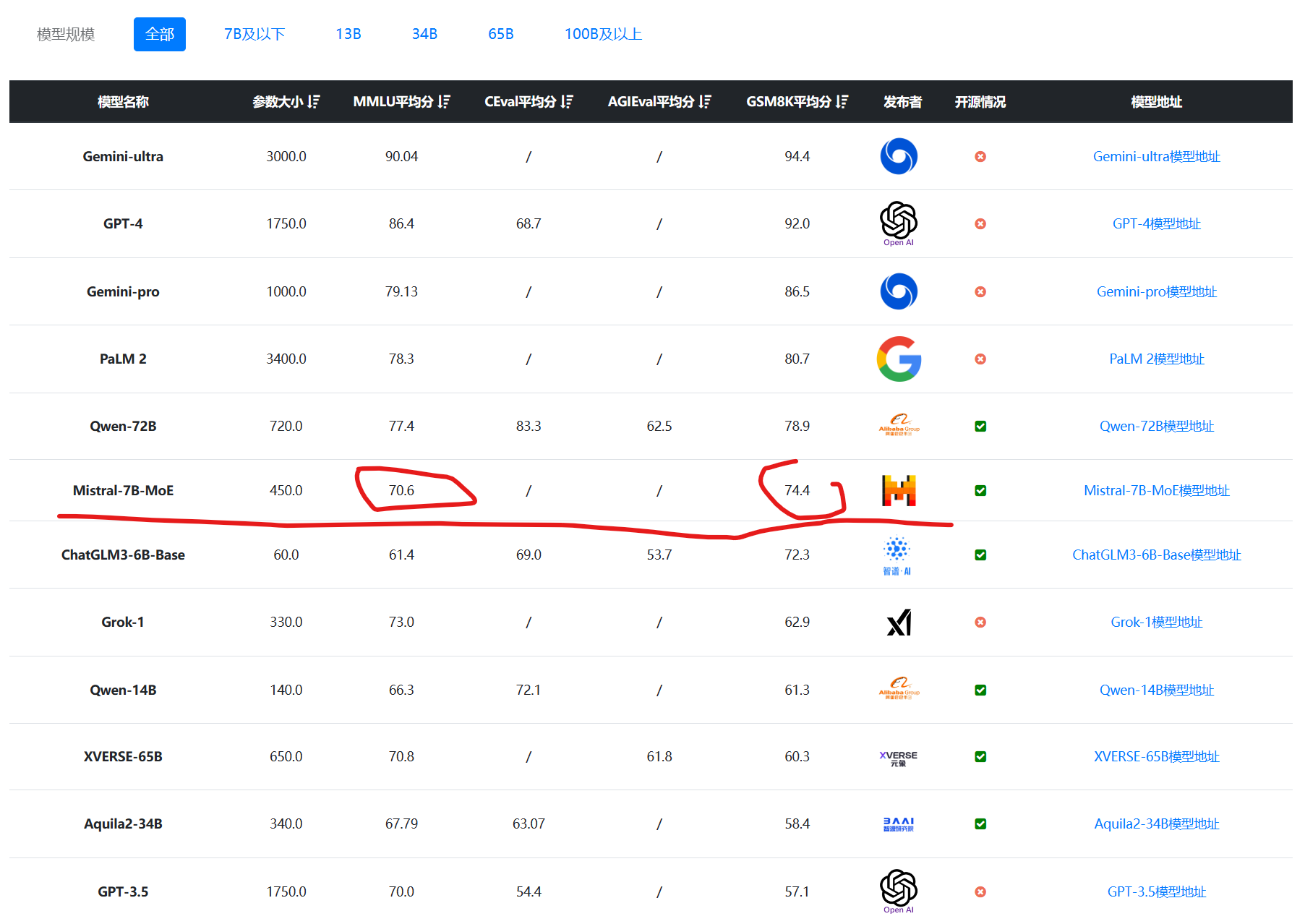

下图是DataLearnerAI大模型评测排行结果:

而代码生成能力的结果,则和CodeLLaMA2-34B在一个水平,要知道,这是一个基座大模型,不是编程大模型,这个结果非常不错,具体参考DataLearnerAI的大模型编程能力排行:https://www.datalearner.com/ai-models/llm-coding-evaluation

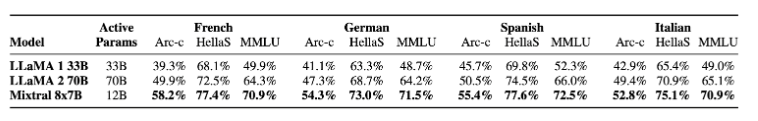

Mistral-7B×8-MoE的多语言能力

除了前面的常规评测外,Mistral-7B×8-MoE另一个吸引人的特点是它多语言支持效果很好。目前在法语、西班牙语、德语、意大利语上的表现都非常亮眼。

不愧是法国企业,在支持欧洲语言上非常棒。从图中也可以看到,Mistral-7B×8-MoE在法语、德语、西班牙语和意大利语表现比LLaMA2-70B系列明显更优!

混合专家技术为Mistral-7B×8-MoE带来的价值

Mistral-7B×8-MoE模型在多个评测基准上都超过了LLaMA2 70B模型,但是它的推理速度比LLaMA2-70B快6倍。因此是一个性能与速度兼备的大模型。

根据官方的介绍,Mistral-7B×8-MoE实际的参数为450亿,但是每次运行只会利用其中120亿参数(单个模型在56.5亿,但是可能有共享参数,每个token会被2个模型处理)。因此,这个模型的推理速度和成本与120亿参数规模的大模型是一样的。

如果GPT-3.5是1750亿的话,这意味着,Mistral-7B×8-MoE混合专家模型,可以每次只需要120亿参数参与推理就可以达到700亿的LLaMA2、1750亿的GPT-3.5的水平。而代码能力则和340亿的编程大模型CodeLLaMA2-34B差不多!这个成本与性能表现十分强悍!

Mistral-7B×8-MoE资源和其它信息

首先,Mistral-7B×8-MoE的官方HF库上有兼容vLLM的权重,非常快。而且支持bitsandbytes的8-bit和4-bit量化使用。并且支持Flash Attention 2。

Mistral-7B×8-MoE模型开源协议是Apache2.0,商用友好,更多Mistral-7B×8-MoE信息参考DataLearnerAI模型信息卡:https://www.datalearner.com/ai-models/pretrained-models/Mistral-7B-MoE